Konkurrenz bei AI: Start-up Wave Computing kauft ARM-Konkurrenten MIPS

Der im Jahr 2010 gegründete kalifornische Chipentwickler Wave Computing spezialisiert sich auf schnelle und effiziente Chips für Künstliche Intelligenz, Deep Learning und neuronale Netzwerke. Nun übernimmt das Start-up den ARM-Konkurrenten MIPS Technologies – einen echten Silicon-Valley-Veteran.

Wave Computing interessiert an MIPS-Chips und -Patenten

Nach wechselnden Besitzverhältnissen und zwei Börsengängen gehört MIPS seit Herbst 2017 der Investmentfirma Tallwood Venture Capital, die damals 65 Millionen US-Dollar für das Chip-Unternehmen gezahlt hatte. Wave Computing ist mit hoher Wahrscheinlichkeit an zahlreichen Patenten des im Jahr 1984 gegründeten Unternehmens interessiert. Darüber hinaus bietet MIPS ein breiter aufgestelltes Produktportfolio, aus dem Wave Computing Kapital schlagen möchte, ist das Start-up doch bisher nur Nischenanbieter. Über den Kaufpreis ist noch nichts bekannt.

Bereits zu Beginn dieses Jahres hatte Wave Computing angekündigt, in Zukunft auf Mikrochips mit MIPS-Technologie statt auf ARM- oder RISC-V-Produkte zu setzen. Vier der sieben Ressortleiter von Wave Computings, darunter der CEO, haben zuvor bei MIPS gearbeitet.

Schon jetzt hält das Unternehmen über 70 Patente, mit dem Einkauf kommen zahlreiche weitere hinzu; MIPS sprach von kombiniert 425 erteilten oder beantragten Patenten. Seit der Gründung im Jahr 2010 hat das Start-up mehr als 100 Millionen US-Dollar an Kapital eingesammelt, zu den Geldgebern zählt auch Tallwood Venture Capital.

Deep Learning und neuronale Netze

Wave Computings Mikrochips sind unter anderem für das Training künstlicher Intelligenzen gedacht. Der Begriff der künstlichen Intelligenz bezieht sich hier allgemein auf Technologien wie Deep Learning oder neuronale Netzwerke, die lose auf menschlichen Gehirnen basieren. Anstatt Computern spezifische Anweisungen zu geben, werden KIs beispielsweise durch ein Training mit vielen realen Daten darin geschult, Muster zu erkennen.

Aber künstliche Intelligenz erfordert Rechenleistung, vor allem die Trainingsphase, aber auch die Inferenz-Phase, in der die gelernten Muster angewendet und verbessert werden. Aus diesem Grund liefert sich das Silicon Valley einen Wettstreit um effizientere KI-Mikrochips. Laut Strategy Analytics haben die Chiphersteller 2017 mehr als 250 Millionen Prozessoren mit integrierten KI-Chips ausgeliefert; Tendenz steigend. In Mobiltelefonen bewältigen solche Prozessoren beispielsweise Sprachbefehle oder versuchen herauszufinden, was eine Kamera gerade sieht.

Wave Computing zielt auf Nvidias Marktherrschaft

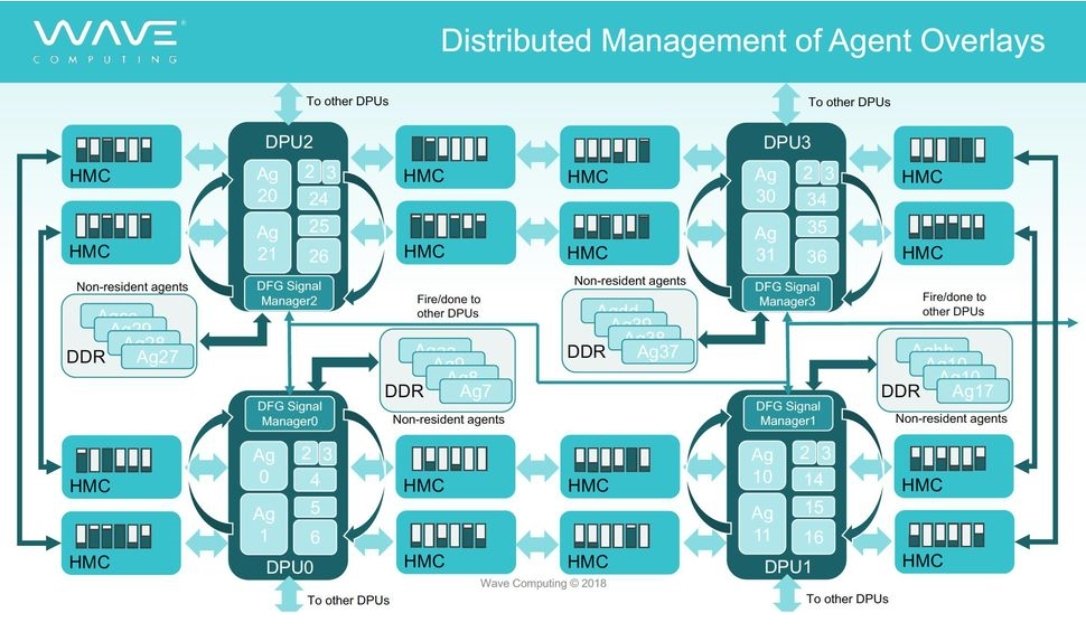

Das kalifornische Unternehmen bezeichnet die eigenen KI-Chips als Dataflow Processing Units (DPU). Vier dieser DPUs werden zusammen mit Micron Hybrid Memory Cubes, also DRAM-Stapeln, auf einem Board verbunden und davon wiederum vier Platinen kombiniert. Googles Tensorflow wird unterstützt.

Wie Golem.de anmerkt, ist bereits eine einzelne DPU bei einem Geschwindigkeitstest mit dem Word2Vec-Datensatz schneller als zwei Intel-Xeon und vier Nvidia Tesla V100; die theoretische Rechenleistung des Wave-Deep-Learning-Computers läge demnach bei 2,9 Teraops.