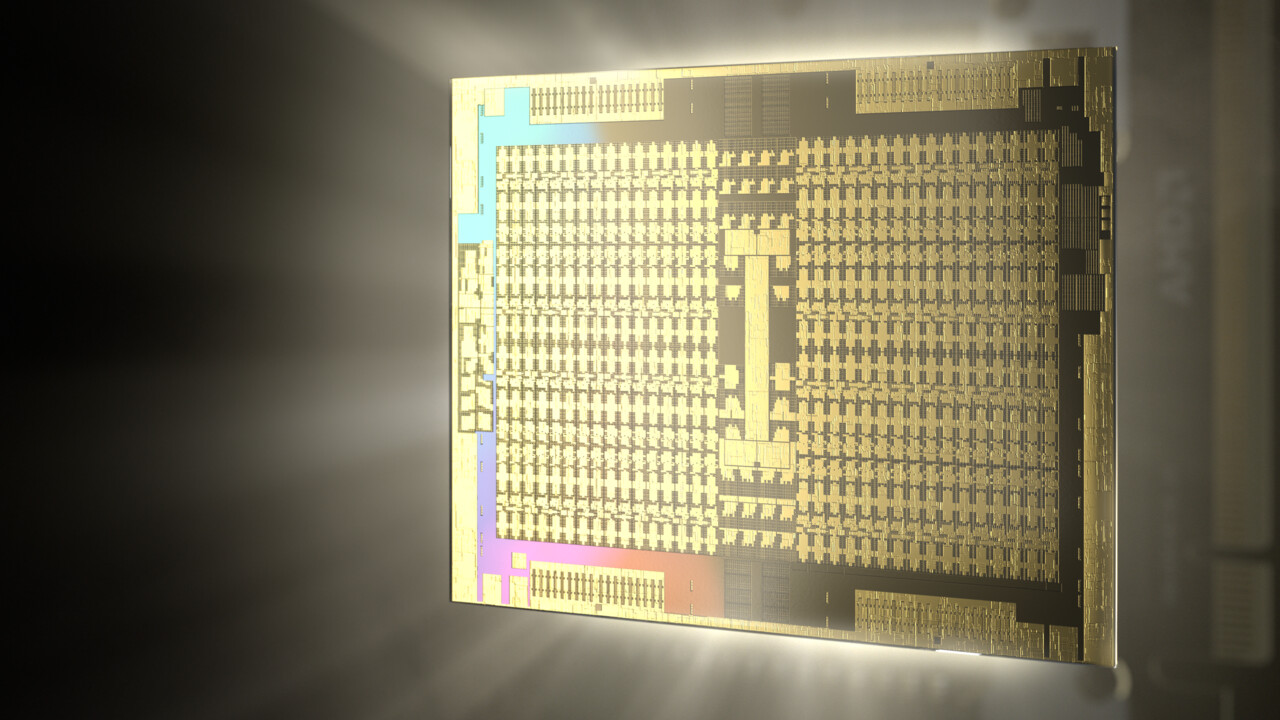

AMD Aldebaran: Profi-Grafikkarten bekommen zwei GPU-Dies und 224 CUs

Die neue AMD-Profi-Grafikkarte mit zwei GPUs auf einem Package nimmt in Form von Aldebaran Gestalt an. 224 CUs werden aktuell vermutet, womit AMD bei den neuen Beschleunigern der Instinct-Familie nicht den Maximalausbau nutzen, sondern vermutlich aufgrund der Ausbeute eine Nummer kleiner einsteigen würde.

Bereits seit Beginn des Jahres wird der Codename Aldebaran in diversen Einträgen geführt, was auf eine erste Unterstützung der Software für neue GPUs hindeutet. Diese wird stetig ausgebaut und die neueste Erkenntnis ist die Bestätigung, dass es sich bei der vermutlich MI200 genannten Karte aus der Familie Radeon Instinct um ein Multi-Chip-Modul handelt, das mindestens zwei GPU-Dies auf einem Package vereint. Das zeigen Patch-Notes eines Senior Members der Technical Staff von AMD.

On aldebaran, only primary die fetches valid power data. Show

power/energy values as 0 on secondary die. Also, power limit should not

be set through secondary die.

Vollausbau soll etwas mehr CUs bieten

Passend dazu gibt es Gerüchte, wonach pro GPU der Vollausbau bei 128 CUs (8.192 FP32-ALUs) liegen soll, was ein kleiner Sprung gegenüber der aktuellen Serie wäre, die 120 CUs und damit 7.680 Shader bietet. Durch zwei Dies würde die Anzahl auf maximal 256 CUs und beachtliche 16.384 ALUs anwachsen. Vermutlich wird AMD zu Beginn jedoch eine Variante mit leicht weniger CUs auf den Markt bringen, eine bei High-End-GPUs als auch -CPUs nicht unübliche Vorgehensweise, um die Ausbeute zu steigern und die Leistungsaufnahme im Zaum zu halten. Diese Umsetzung würde dann mit zwei Mal 112 CUs und damit 14.336 FP32-ALUs daher kommen.

Neuer Speichertyp HBM2e

Neben den zwei GPUs wird darüber hinaus auch noch HBM2e auf dem Package seinen Platz finden, so wie es aktuell bei der Instinct MI100 und damit dem direkten Vorgänger der Fall ist. Dieser gilt nicht per se als stromsparend und trägt ebenfalls seinen Anteil zur Boardpower der Karte bei. Ob es beim „MI200“ Anpassungen am Speichercontroller und der Speichermenge geben wird, ist noch nicht klar. Die MI100 setzt nur auf vier Chips mit jeweils 8 GByte, Nvidias Ampere-Lösung auf fünf mit jeweils 16 GByte, die so mit 80 GByte HBM2e das Maximum im Markt repräsentieren. Der bisherige sechste Dummy-Die könnte bei Nvidia in einer kommenden Generation auch genutzt werden, sodass AMD hier in Zugzwang kommt.

AMD-CEO Lisa Su hatte kürzlich erklärt, dass die CDNA-2-Architektur für das Profi-Segment noch in diesem Jahr vorgestellt wird. Die stetig zunehmenden Einträge in entsprechender Software untermauern dies und dürften bis zum Start ein stetig genauer werdendes Bild abliefern.