Nvidia Omniverse: Ich simulier' mir die Welt, widewide wie sie mir gefällt

Das Nvidia Omniverse, eine Simulations-Plattform für das Erstellen und Verbinden digitaler Welten, erhält zur GTC einen erweiterten Funktionsumfang. Vom Enterprise-Segment macht Omniverse für RTX-Kunden mit „Showroom“ einen kleinen Schritt zum normalen Consumer. Betas für „Farm“, „AR“ sind zur GTC verfügbar, „VR“ soll folgen.

Omniverse ist eine Kollaborations-Plattform, auf der sich digitale Welten erstellen und miteinander verbinden lassen. Die Plattform nutzt das ursprünglich von Pixar entwickelte Universal Scene Description (USD) als „HTML für 3D-Rendering“, um Kompatibilität unter professionellen Anwendungen aus dem 3D-Umfeld zu erhalten, unter anderem von Adobe, Autodesk, Blender, Graphisoft, MathWorks oder auch der Unreal Engine.

Die Services für die Verwaltung der digitalen Welten werden über Omniverse Nucleus verwaltet, während die sogenannten Connectors als Plugins für Client-Anwendungen zu verstehen sind, die sich darüber in das Omniverse einklinken. Zur GTC kommen 14 neue als Beta hinzu, davon 6 vollständig neue. An Bord sind jetzt Esri mit der ArcGIS CityEngine, PTC mit OnShape, Reallusion mit iClone, Replice mit AI Voice, Radical mit AI Pose Estimation und Lightmap mit HDR Light Studio.

Für Enterprise-Kunden ab 9.000 US-Dollar im Jahr

Der Software-Stack für den Zugriff auf das Omniverse, der sich auf von Nvidia zertifizierten Servern ausführen lässt, ist zur GTC für Enterprise-Kunden verfügbar und startet bei einer Jahresgebühr von 9.000 US-Dollar. Dazu gehören dann zwei sogenannte „Floating Licenses“ für das Creator-Modul im Omniverse, zehn Viewer, nur um die Projekte betrachten, aber nicht bearbeiten zu können, und vier Nucleus-Lizenzen. Entsprechend zertifizierte Systeme und Lizenzen für das Omniverse werden aus einer Hand von Anbietern wie Boxx, Dell, Lenovo, PNY oder Supermicro vertrieben.

„Wir können uns damit Superkräfte geben“

Nvidia spricht bei den Omniverse-Welten von digitalen Zwillingen der echten Welt. Die echte Welt soll damit aber nicht ersetzt werden, wenn es etwa um Simulationen geht, sondern lediglich ergänzt werden, etwa in Bereichen, die sich nicht mal eben so in der echten Welt abbilden lassen. Ganze Fabriken können zum Beispiel Autohersteller im Omniverse anlegen, laufen lassen und Auswirkungen kleiner Veränderungen reproduzierbar unter gleichen Bedingungen testen. Das Verhalten autonomer Roboter kann im Omniverse mittels Isaac Sim Replicator risikofrei ausgewertet werden.

Städte und Waldbrände entstehen im Omniverse

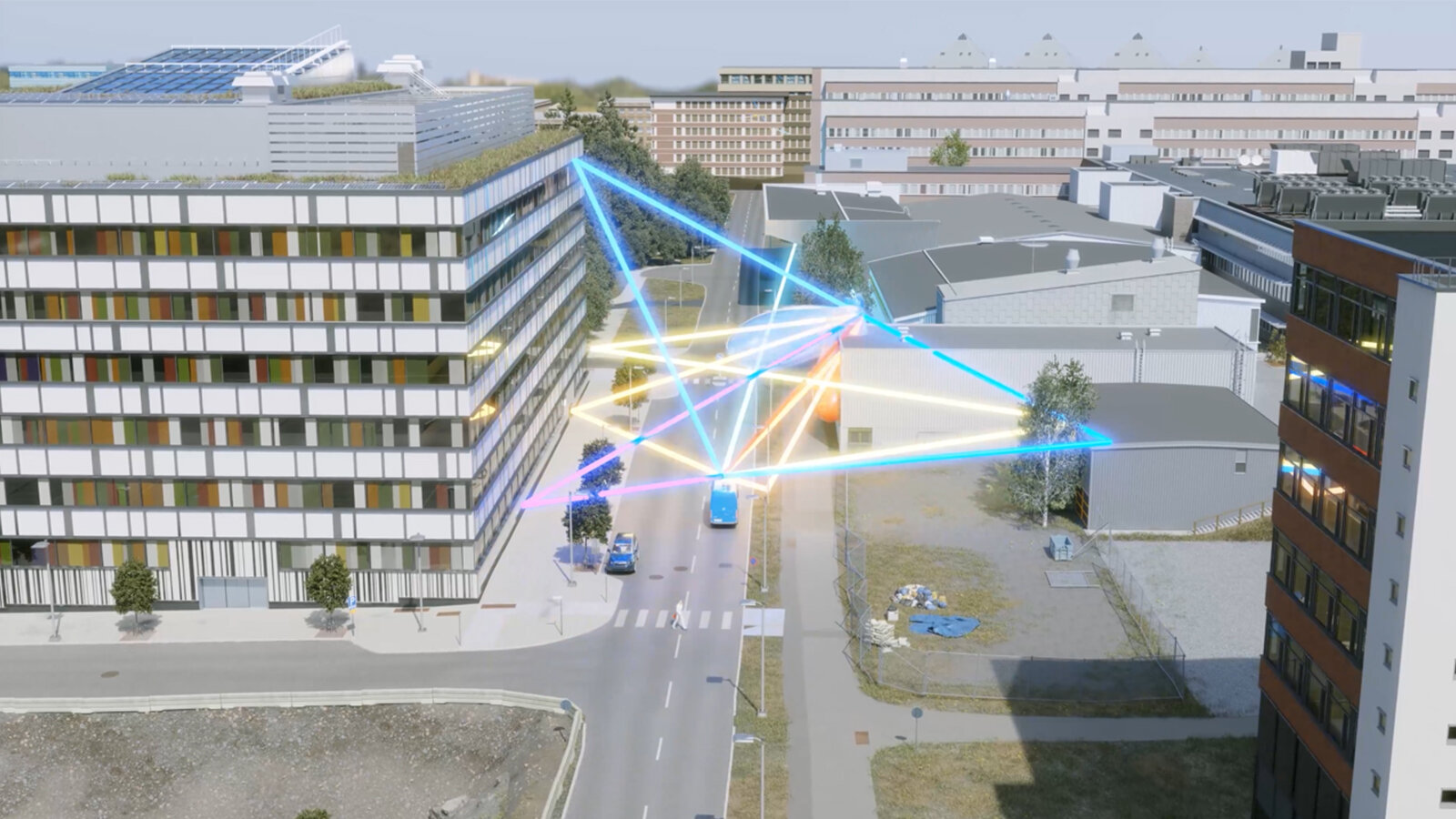

Ericsson baut ganze Städte digital im Omniverse nach, um den 5G-Ausbau hinsichtlich der Ausbreitung von Funkwellen zu optimieren, wie eine Demo zur GTC zeigt. Nvidia, Lockheed Martin und die „State and Federal Forest Services“ lassen zur GTC riesige Waldbrände im Omniverse lodern, um deren Verhalten zu analysieren und Methoden zum Löschen zu entwickeln. „Wir können uns damit Superkräfte geben“, erklärt Nvidia, denn letztlich lassen sich völlig risikofrei ganze Bereiche der echten Welt physikalisch korrekt im Omniverse abbilden.

Analog zum Isaac Sim Replicator gibt es den Drive Sim Replicator, der beim Training autonomer Fahrzeuge genutzt wird. Zur GTC zeigt Nvidia außerdem den Omniverse Avatar, der mehrere SDKs von Nvidia für Sprache (Riva), Wahrnehmung (Metropolis), Empfehlungen (Merlin), Skalierbarkeit (Fleet Command) sowie im letzten Schritt Animation und Rendering (Omniverse) verbindet, um Avatare für digitale Assistenten zu erstellen, die in Restaurants, Banken oder Reservierungssystemen zum Einsatz kommen könnten. Auch der Drive Concierge im Auto ist einer dieser digitalen Avatare.

Omniverse erhält neue Features

Im Rahmen der GTC schaltet Nvidia eine Reihe neuer Betas für das Omniverse frei. Mit „Showroom“ halten alle RTX-Nutzer über eine vereinfachte Benutzeroberfläche Zugriff als Betrachter auf Demos innerhalb des Omniverse. Bei „Farm“ handelt es sich um einen neuen System-Layer für Multi-GPU- und Multi-Agent-Rendering und Simulationen, um diese über mehrere lokale sowie in der Cloud gelagerte Rechner respektive Server abzuwickeln. Nvidia selbst hat Farm bei der letzten GTC im Frühjahr genutzt, um alle während der Keynote gezeigten Produkte zu rendern. Dabei wurden mehr als 60.000 Frames verteilt auf 800 Maschinen gerendert. Zur aktuellen GTC hat Nvidia die Anzahl jeweils verdoppelt. Neu als Beta ist auch „AR“, um direkt aus dem Omniverse auf Geräte mit Android und iOS zu streamen, die als Anzeigegeräte für Augmented Reality genutzt werden. Zu einem späteren Zeitpunkt soll „VR“ für Omniverse folgen, um Inhalte auf VR-Headsets zu streamen – in laut Nvidia voller Qualität inklusive Raytracing.

ComputerBase hat Informationen zu diesem Artikel von Nvidia unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

- Nvidia Studio-Treiber 472.47: Grafiktreiber für die neuesten Werkzeuge im Omniverse

- Nvidia A2: KI-Beschleuniger kommt im kleinen HHHL-SS-Format

- Nvidia Omniverse: Ich simulier' mir die Welt, widewide wie sie mir gefällt

- +4 weitere News