Nvidia auf der IAA: Wie Generative AI beim autonomen Fahren helfen kann

AI ist in aller Munde, kaum eine Konferenz oder Keynote kommt mehr ohne das Buzzword aus. Auch an der Automesse IAA geht das Thema nicht vorbei. In beiden Bereichen – AI und Auto – ist vor allem Nvidia mit Lösungen vertreten. Zur Messe in München hat sich ComputerBase mit Nvidias Chef der Automotive-Sparte darüber unterhalten.

Das Thema Künstliche Intelligenz – kurz AI – wird aktuell in einer derart hohen Schlagzahl genannt, als gäbe es ein neues Allheilmittel, um alle weltlichen Probleme mit nur einem Klick zu lösen. Nicht von der Hand zu weisen ist, wie groß der unterstützende Effekt von AI zum Beispiel in der Arbeitswelt sein kann. Im Zentrum dieser Entwicklung steht insbesondere das Unternehmen Nvidia, das schon sehr früh das Potenzial von AI erkannt und sich entsprechend darauf ausgerichtet hat. Praktisch kein Rechenzentrum kommt mehr ohne die AI-Beschleuniger des Unternehmens aus, um stetig größere Large Language Models, die Technologie hinter ChatGPT und Co, effizient zu trainieren.

Die Zahlen sprechen für sich

Der Erfolg Nvidias in diesem Bereich spiegelt sich in den Quartalsergebnissen wider. Mal eben 171 Prozent mehr Umsatz mit der Data-Center-Sparte von einem Jahr auf das andere? AI macht es möglich. Das Unternehmen kann sich kaum vor Bestellungen für aktuelle Lösungen wie A100 und H100 retten und hat eine massive Pipeline neuer Produkte in der Hinterhand, zu denen etwa der GH200 Grace Hopper Superchip gehört.

Automotive-Sparte nimmt an Fahrt auf

Nvidias Automotive-Sparte verzeichnet zwar ebenfalls Erfolge, mit einem Umsatz von zuletzt 253 Millionen US-Dollar im zweiten Finanzquartal 2024 kommt der Konzern aber lediglich auf ein Vierzigstel der alles überschattenden Data-Center-Sparte. Der Trend zeigt aber auch hier nach oben: Über die letzten vier Quartale gab es jeweils eine teils deutliche Steigerung zum Vorjahr, in der ersten Hälfte des Fiskaljahres 2024 lag das Plus bei 53 Prozent. Kam Nvidia im gesamten Fiskaljahr 2023 noch auf einen Automotive-Umsatz von rund 900 Millionen US-Dollar, hat das Unternehmen zuletzt im März dieses Jahres den prognostizierten Umsatz auf Basis der sogenannten Design Win Pipeline, der abgeschlossene Verträge zugrunde liegen, von 11 auf 14 Milliarden US-Dollar für die nächsten sechs Jahre bis inklusive 2028 angehoben.

Mercedes-Benz setzt auf Nvidia

Zu den Abnehmern der Automotive-Lösungen von Nvidia gehören Branchengrößen wie Polestar und Volvo, BYD und Zeekr, Jaguar Land Rover, Lucid und zur Münchener Automesse besonders in Szene gesetzt auch Mercedes-Benz mit dem Concept CLA Class, das Nvidias „Supercomputer“ fürs Auto in den Fußraum versetzt, blau beleuchtet und mit Wasser kühlt. Die Stuttgarter wollen ab 2024 mit Nvidias Drive AGX Orin das automatisierte Fahren auf die nächste Stufe heben. Mit Drive Thor steht bei Nvidia ab 2025 eine nochmals deutlich leistungsfähigere Plattform bevor, die als Zentralcomputer neben dem assistierten und automatisierten Fahren auch für das digitale Kombiinstrument, das Monitoring von Fahrer und weiteren Personen im Auto sowie die Wiedergabe des Infotainmentsystems und das Rear-Seat-Entertainments zuständig sein wird.

Nvidia verdient mit

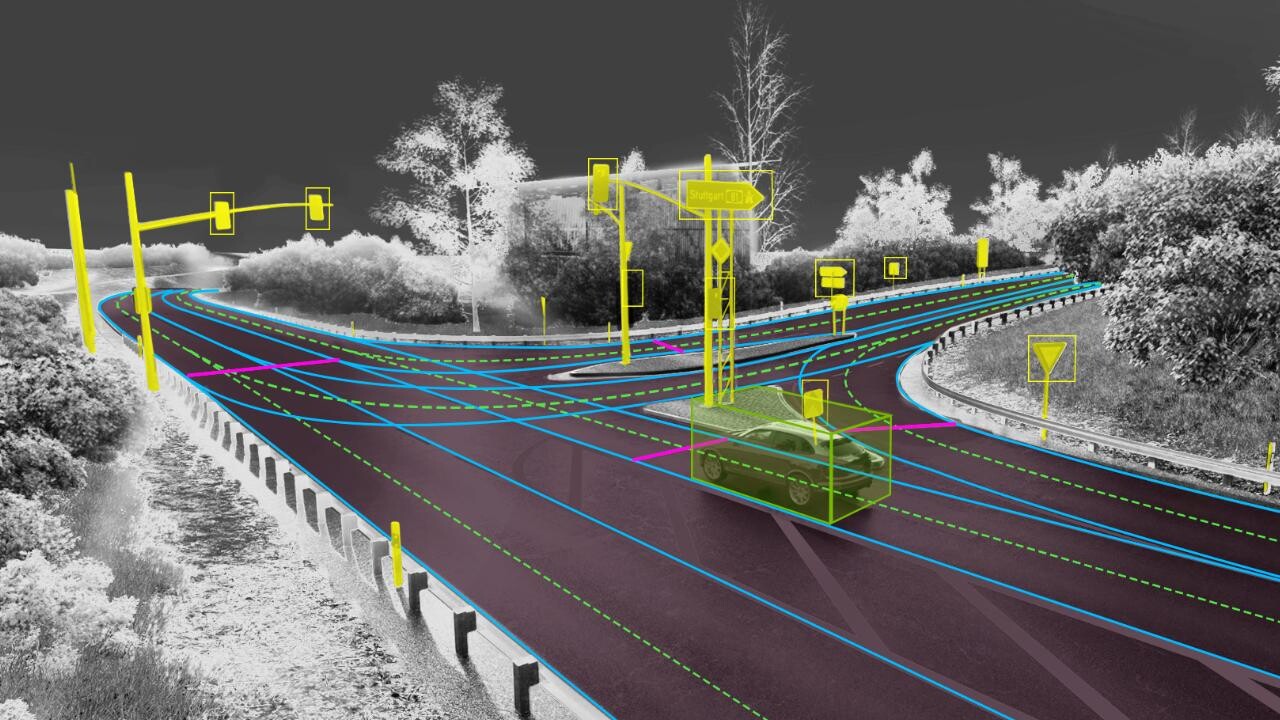

Nvidias Umsatzprognosen basieren jedoch nicht nur auf dem einmaligen Verkauf von Hard- und Software für Autos, sondern auch auf individuell verhandelten Umsatzbeteiligungen bei den Autoherstellern, wie Danny Shapiro, VP of Automotive, im Gespräch mit ComputerBase zur IAA erläutert. Verkaufen die Hersteller viele Fahrzeuge, profitiert davon über die Software somit auch Nvidia. Umsatz generiert das Unternehmen aber nicht nur über die Chips im Auto oder die Software, die darauf läuft, sondern auch mit Referenzarchitekturen wie der Drive Hyperion in künftig bereits 9. Generation oder der Simulation für selbstfahrende Fahrzeuge, da Testkilometer, wie sie für das autonome Fahren benötigt werden, nicht mehr nur in der realen Welt abgespult werden können. Das ist gemessen an den benötigten Szenarien schlichtweg nicht mehr zu realisieren.

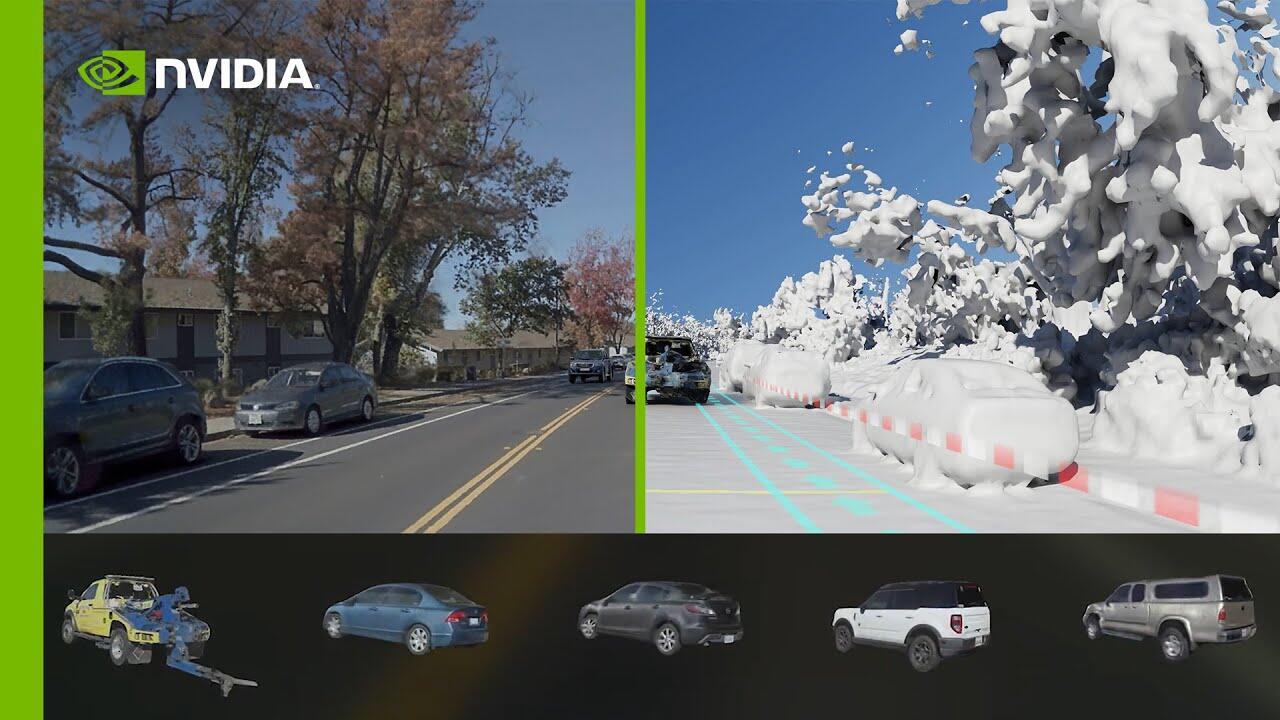

AI generiert die simulierte Welt

Mit Hilfe der Neural Reconstruction Engine wandelt Nvidia stattdessen während der Fahrt erfasste Videodaten in interaktive 3D-Testumgebungen, in denen Entwickler Szenarien mannigfaltig ändern, synthetische Objekte hinzufügen und Randomisierungen anwenden können, wie es mit Fahrten in der echten Welt nicht möglich wäre. So lässt sich das Ausgangsszenario noch herausfordernder oder mit selten anzutreffenden Eigenschaften gestalten. Diese auf echten Umgebungen basierenden, jedoch auch vollständig neu erstellten Simulationen laufen bei Nvidia im Omniverse, dem digitalen Zwilling der echten Welt, der für immer mehr Bereiche genutzt wird. Dabei können Entwickler auch auf Generative AI zurückgreifen, also zum Beispiel ähnlich wie bei Stable Diffusion über Textbefehle neue Welten erstellen, sodass diese nicht mehr prozedural oder gar manuell generiert werden müssen. Dadurch lässt sich die Varietät steigern, aber vor allem der Aufwand reduzieren. AI ersetzt den Entwickler demnach nicht, sondern unterstützt diesen bei der Arbeit, gestaltet diese effizienter, macht Kapazitäten frei und erhöht zugleich den Output.

Da sich im Omniverse mittlerweile aber deutlich mehr abspielt als die simulierten Fahrten, lässt sich Generative AI für weitere Bereiche wie den kollaborativen Designprozess nutzen. Lassen sich Designer bislang zum Beispiel von der Natur, historischen Fahrzeugen und anderen visuellen Quellen inspirieren, kann künftig auch Generative AI einen Teil dazu beitragen und über simpel strukturierte Befehle einen ersten Sketch erstellen. Bei Toyota kommt diese AI-Technik bereits zum Einsatz und arbeitet im Rahmen durch Ingenieure vorgegebener Parameter, um gewisse Zielwerte wie etwa die gewünschte Größe bei der Entwicklung eines neuen Autos einzuhalten. Die dafür benötigten AI-Modelle lassen sich auf den Data-Center-Lösungen von Nvidia trainieren, während virtuelle Fabriken, frühere, aktuelle und künftige Bauteile, Farben und mehr eines Konzerns mit potenziell mehreren Automarken digital im Omniverse hinterlegt werden und so in den Designprozess einfließen können.