Core ML für UL Procyon: Apple-Silicon-Support für den 5.000-USD-AI-Benchmark

ULs AI-Inference-Benchmark „AI Computer Vision Benchmark“ als Teil der Procyon-Benchmark-Suite ist ab sofort auch für macOS verfügbar. Erst vor zwei Wochen hatte ComputerBase die Suite zum Vergleich der AI-Leistungsfähigkeit von Intel Core Ultra 100H, AMD Ryzen 8000 Mobile und GeForce RTX 4000 Laptop GPU unter Windows genutzt.

Jetzt auch mit Apple Core ML

Möglich ist das durch die Integration von Apples API Core ML, die AI-Beschleunigung unter macOS, iOS, iPadOS und Co auf den hauseigenen Chips ermöglicht. Anwender haben dabei generell und auch im Procyon AI Computer Vision Benchmark die Wahl, auf welcher Komponente des SoC die AI-Lasten ausgeführt werden sollen.

- CPU

- CPU + GPU

- CPU + NPU (Neural Engine)

- CPU + GPU + NPU (Neural Engine)

Obwohl Core ML auch auf mobilen Endgeräten von Apple verfügbar ist, setzt der Procyon AI Computer Vision Benchmark bisher nur auf macOS. Da es allerdings schon länger eine Android-Version gibt, dürfte die iOS-iPadOS-Variante nicht mehr lange auf sich warten lassen.

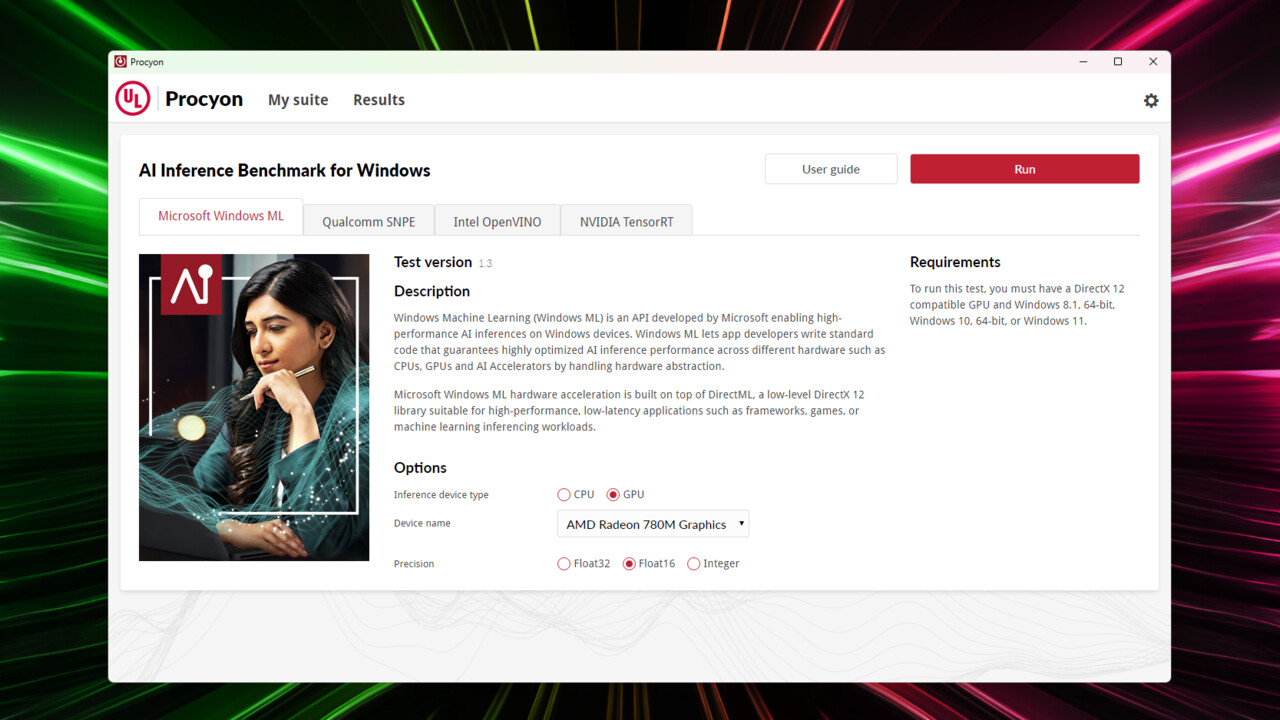

Für Benchmarks unter Windows standen in Procyon bisher die APIs Microsoft Windows ML (CPU inkl. NPU oder GPU), Intel OpenVino (CPU, GPU oder NPU) und TensorRT (Nvidia RTX GPU) zur Auswahl.

Das Update ist kostenlos, der Benchmark nicht

Inhaber einer gültigen Lizenz für den AI Computer Vision Benchmark der Procyon Suite erhalten den macOS-Support per Software-Update kostenlos. Eine Lizenz für den Benchmark kostet wiederum 5.000 US-Dollar pro Jahr. Sie berechtigt zur Ausführung des Benchmarks an einem Unternehmensstandort ohne Begrenzung der Nutzer- oder Geräteanzahl.

Mit dem Procyon AI Image Generation hatte UL erst Anfang April einen weiteren AI-Benchmark im Rahmen der Procyon Suite veröffentlicht, der den Fokus auf die AI-Bildgenerierung legt. Auch in diesem Fall werden 5.000 USD für die Standort-Jahreslizenz fällig. Eine macOS-Version gibt es in diesem Fall noch nicht.