Google I/O 2024: Google-Suche erhält generative AI – und erstellt Antworten selbst

Wie erwartet hat Google bei der Entwicklerkonferenz I/O 2024 auch zahlreiche Neuerungen für die Suchmaschine vorgestellt. Generative AI hält Einzug, von nun an wird Google auch generierte Antworten präsentieren.

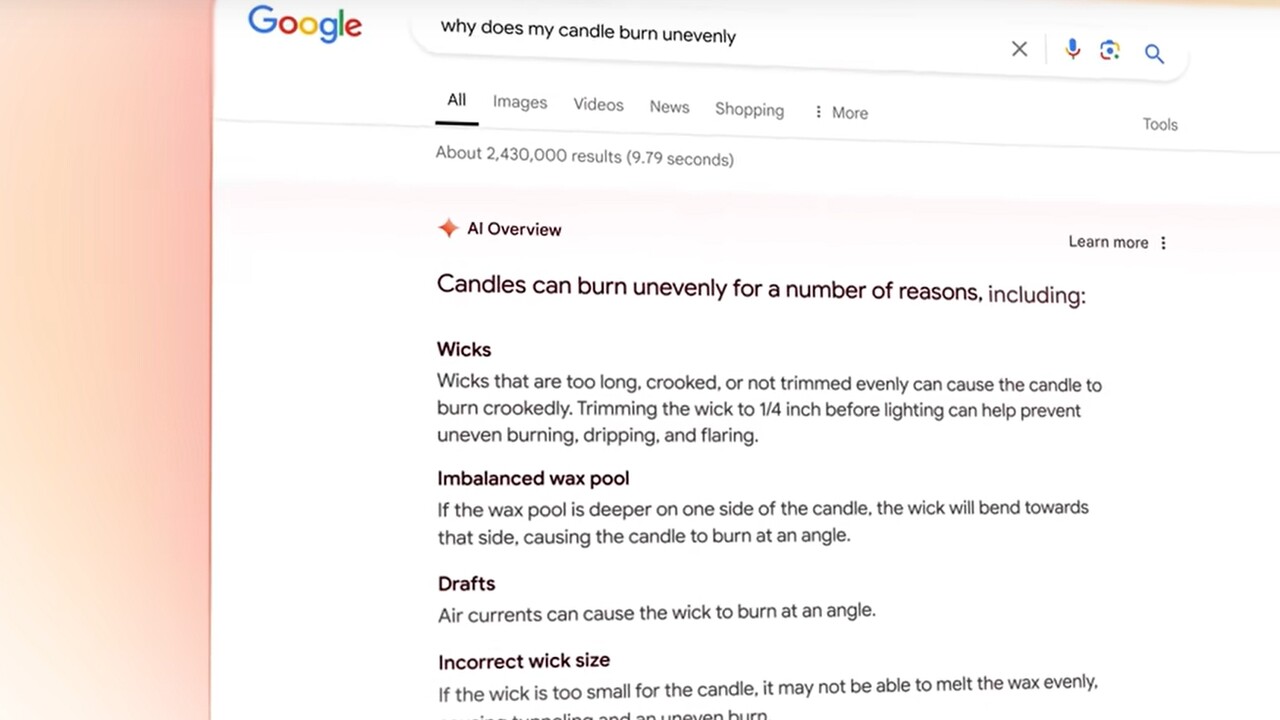

Das generative AI-Feature läuft unter dem Projektnamen AI Overview, Nutzer erhalten damit eine erste Antwort auf eine Suchanfrage. Technische Grundlage ist ein angepasstes Gemini-Modell.

Die generative AI-Antwort erscheint als erstes auf der Ergebnisseite, darunter folgen weiterführende Links sowie die „Weitere-Fragen“-Sektion – und dann die klassische Liste mit Suchergebnissen. Anzeigen werden ebenfalls dargestellt

Nutzer konnten es seit geraumer Zeit in den Search Labs testen, nun erfolgt in den USA der schrittweise Start für alle Nutzer. Weitere Länder sollen bald folgen. Wer die neue AI-Suche nicht nutzen will, kann diese mit einem Web-Filter umgehen.

Links sollen weiter angeklickt werden

Google bewirbt das Feature mit der Aussage, dass Nutzer einen schnellen Überblick zu einem Thema erhalten sollen. Gleichzeitig betont man aber, dass Nutzer weiterhin auf Links klicken – und das sogar mehr als beim herkömmlichen Suchmaschinenformat. „Während wir diese Funktion für mehr Menschen verfügbar machen, werden wir uns weiterhin darauf konzentrieren, wertvollen Traffic an Publisher und Creator zu senden“, heißt es in der offiziellen Mitteilung.

Im Prinzip ist es ein juristischer und politischer Disclaimer, den Google direkt versendet. Seit die generative AI-Suche vor einem Jahr angekündigt wurde, befürchten insbesondere Presseverlage einen massiven Traffic-Einbruch, die Rede ist von 40 Prozent und mehr. Was die Sache noch pikanter macht: Für die Antworten – sowie zuvor das Training der Modelle – wurden auch Inhalte der Verlage ausgewertet, Copyright-Klagen wie von der New York Times gegen OpenAI und Microsoft laufen ohnehin.

Google versucht also, die Gemüter zu besänftigen, indem man auf den Erhalt bestehender Geschäftsmodelle verweist. Inwieweit das zutrifft, werden die nächsten Wochen beweisen.

AI-Overview-Funktion lässt sich künftig anpassen

Der vorgestellte AI Overview ist ohnehin nur der Anfang, künftig wird die KI noch um weitere Funktionen ergänzt. So erhalten Nutzer die Möglichkeit, die Antworten individuell anzupassen. Sie können also entweder die Sprache vereinfachen oder mehr Details anfordern.

Indem Google das mehrstufige Schlussfolgern verbessert, soll die Suche künftig auch in der Lage sein, komplexere Fragen zu beantworten. Entsprechende Suchanfragen müssen dann nicht mehr in mehrere Schritte unterteilt werden. Als Beispiel nennt man die Suche nach einem Yoga-Studio, das sich in Laufreichweite befindet und einen Rabatt für Neumitglieder anbietet. Das mehrstufige Schlussfolgern wird bald in den Search Labs für englischsprachige Suchen in den USA verfügbar sein.

Hilfreicher soll die Google-Suche auch beim Planen werden. So kann man in Zukunft etwa nach einen Essensplan für mehrere Personen und Tage mit bestimmten Vorlieben fragen. Die Suche generiert dann einen Vorschlag, der sich direkt in Google Docs und Gmail übertragen lässt. Die Essens- und Reiseplanung ist in den USA ab sofort auf Englisch verfügbar. Später in diesem Jahr sollen Anpassungsfunktionen sowie weitere Kategorien wie Events, Verabredungen und Workouts hinzukommen.

Suchergebnisse auf einer KI-generierten Seite

Dass bei den Suchergebnissen zunächst eine generative AI-Antwort über der klassischen Ergebnisstruktur erscheint, ist der Einstieg. Möglich ist auch, dass Ergebnisseiten komplett generiert werden – ein Konzept, das auch der Arc-Browser verfolgt. Bei englischsprachigen Anfragen in den USA will Google nun ebenfalls eine per generative AI organisierte Ergebnisseite anzeigen, wenn Nutzer „nach Inspiration“ suchen.

Gemeint sind damit Anfragen zum Thema Essen und Rezepte. Es folgen aber noch Bereiche wie Filme, Musik, Bücher, Hotels oder Shopping.

Visuelle Suchfortschritte

Perspektivisch will Google die Suche um visuelle Elemente ergänzen. Google Lens ist dann etwa in der Lage, komplette Kameraaufnahmen in Echtzeit aufzunehmen. Es ist also der multimodale Ansatz, den Google schon bei der Vorstellung der neuen AI-Modelle in den Mittelpunkt rückte. Die Videosuche befindet sich aber noch in einem früheren Entwicklungsstadium. Bald soll diese in den Search Labs verfügbar sein, zunächst aber wieder nur in den USA.

- Copilot+, GPT-4o & Gemini: Die Next-Gen-AI-Assistenten könnten tatsächlich nützlich sein

- „Ask Photos“: Google-Fotos-Galerie mit natürlicher Sprache durchsuchen

- Google I/O 2024: Google-Suche erhält generative AI – und erstellt Antworten selbst

- +3 weitere News