25 Jahre Radeon: Von ATi R100 bis AMD RDNA 4

Die Marke Radeon wird heute 25 Jahre alt. Sie steht vor allem (aber nicht nur) für Grafiklösungen für PCs von der integrierten GPU bis zur High-End-Grafikkarte. Erschaffen von ATi Technologies gehört Radeon seit knapp 20 Jahren zu AMD. ComputerBase blickt zurück auf Höhen und Tiefen von ATi R100 bis AMD RDNA 4.

Jahr 2000: Alles begann mit dem R100

Die Firma ATi Technologies führte die Marke Radeon am 1. April 2000 für die Nachfolger der Rage-Grafikchips ein. Die neue GPU-Architektur wurde Radeon R100 genannt, wobei anfangs noch der Codename Rage 6C genutzt wurde

Die allererste Meldung auf der Themenseite Radeon von ComputerBase sprach schlicht noch vom RADEON. Der in 180 nm bei TSMC hergestellte R100 brachte auf seinen 111 mm² (manche nennen auch 114 mm²) rund 30 Millionen Transistoren unter.

Er sollte als Radeon 256 vermarktet werden und lieferte eine Antwort auf Nvidias GeForce 256, indem er ebenfalls Hardware T&L sowie DirectX 7.0 unterstützte. Die „7“ war dann auch bei den Radeon-Grafikkarten Programm: Die Radeon 7000 waren geboren.

Doch die allererste Radeon-Grafikkarte hörte noch auf den Namen „Radeon DDR“ und kombinierte den R100 mit bis zu 64 MB DDR-Speicher. Erst später wurde sie in Radeon 7200 umbenannt, die es aber auch als Version mit SDR-Speicher und somit halbierter Speicherbandbreite von 2,7 GB/s gab. Die Radeon 7200 (DDR) wurde am AGP-4x-Steckplatz betrieben und war mit 23 Watt TDP spezifiziert. GPU- und Speichertakt waren seinerzeit noch identisch und betrugen je nach Version 183 MHz oder 166 MHz.

Ungewöhnlich war die Aufteilung der Engine: Mit 2×3 konnte sie 2 Pixel gleichzeitig mit 3 Texturen belegen. Und das im Gegensatz zur GeForce in einem Arbeitsschritt, denn die Konkurrenz konnte zwar zwar 4 Pixel gleichzeitig rendern, aber nur eine Textur pro Takt auftragen. Geschuldet war dies dem immer stärker werdenden Multitexturing in Spielen. Beim Nachfolger ging ATi dann jedoch wieder auf eine bewährte 4×2 Architektur zurück.

2001: R200 und Radeon 8000

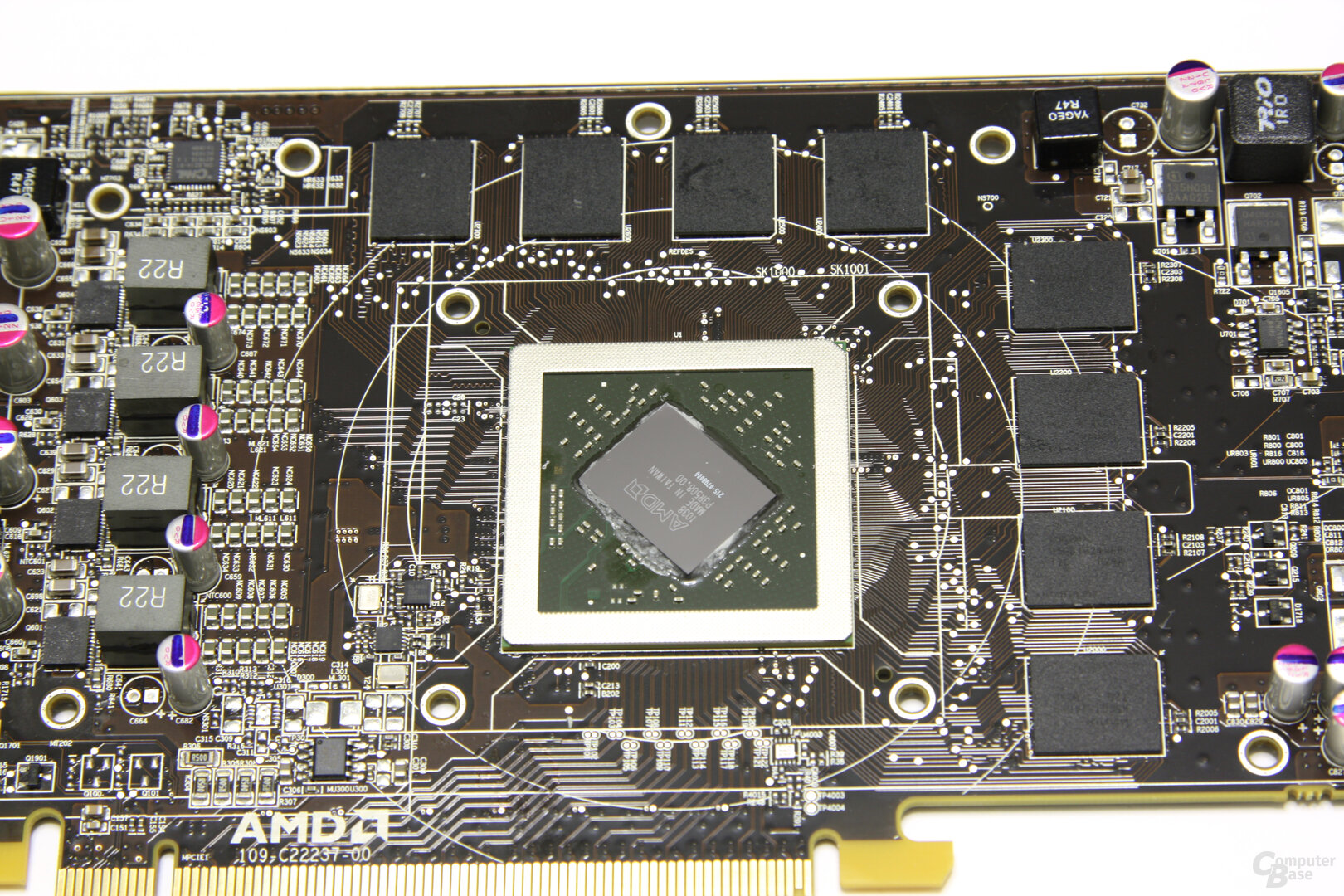

Die zweite Generation der Radeon-Grafikchips hörte auf den Namen R200 (Codename Chaplin) und erschien im August 2001. Die Zahl der Transistoren wurde auf rund 60 Millionen verdoppelt, obwohl die Chipfläche mit etwa 120 mm² nur geringfügig wuchs. Das modernere 150-nm-Verfahren half dabei. Die Zahl der Pixel- und Vertex-Shader sowie der ROPs wurde verdoppelt und der Takt auf zunächst 275 MHz massiv angehoben.

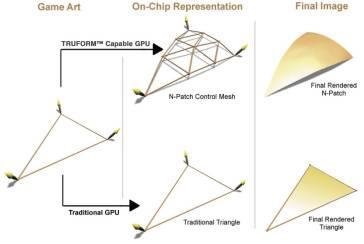

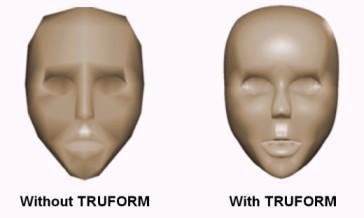

Auch in dieser Generation führte ATi ein experimentelles Feature hinzu: TruForm. Es erlaubte eine automatisch Erhöhung der zu rendernden Dreiecke, um Kurven besser darstellen zu können. Da dies innerhalb des R200 passierte, entstand kein zusätzlicher Aufwand für die CPU oder die Bandbreite von der Northbridge zur GPU.

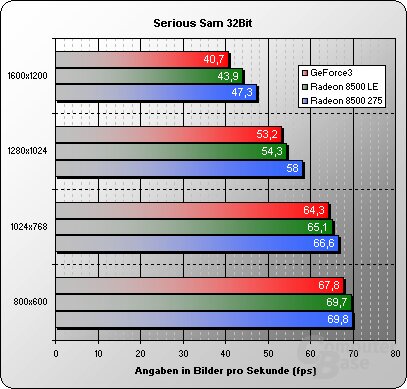

Mit Unterstützung von DirectX 8.0 waren somit die Radeon 8000 geboren und fanden in der Radeon 8500 (Test) ihr erstes Modell, das sich meist (aber nicht immer) gegen Nvidias GeForce 3 durchsetzen konnte.

Die einige Monate später eingeführte ATi Radeon 8500 All-In-Wonder verdoppelte nicht nur den Speicher auf 128 MB DDR, sondern auch den Anschluss auf AGP 8x.

2002: R300 und Radeon 9000

Ziemlich genau ein Jahr nach dem R200 folgte der R300 mit dem Codenamen Khan. Im gleichen 150-nm-Prozess knackte die Zahl der Transistoren die Marke von 100 Millionen, der Chip war mit 215 mm² aber auch fast doppelt so groß. Noch einmal wurden die Shader und ROPs verdoppelt, statt 6 gab es nun 8 Textureinheiten (TMUs).

Mit DirectX 9.0 erfolgte die Einführung der Radeon-9000-Serie als Konter zu Nvidias GeForce 4. Die Radeon 9700 Pro schlug Nvidias Konkurrenzprodukt gerade bei hohen Auflösungen. Nvidia konterte mit FX 5800 (der Föhn), FX 5900 und FX 5950, doch spätestens die Radeon 9800 Pro mit dem R350 ließ auch diese hinter sich. Dank 256-Bit-Interface und 340 MHz schnellen Chips lag der Speicherdurchsatz bei fast 22 GB/s.

2004: R420 und das erste „X“

Die vierte Generation der Radeon-GPUs startete im September 2004 mit dem R420 (Loki), der mit 285 mm² Chipfläche noch einmal größer ausfiel. Die 160 Millionen Transistoren wurden in 130 nm bei TSMC gefertigt. Gegenüber dem R300 wurden die ROPs auf 16 verdoppelt.

Mit den R420-Grafikkarten kam ein neues Namensschema: Die nächste Generation hieß Radeon Xxxx mit dreistelliger Ziffer, dabei ließ DirectX 10 noch auf sich warten. Die Radeon X800 XT (Test) zählte zu den ersten Modellen und musste gegen Nvidias starke GeForce 6800 (Ultra) antreten.

Seinerzeit erfolgte allmählich die Umstellung von AGP auf PCI Express. Es gab zu der Zeit Radeon mit AGP 8x wie auch neuerdings mit PCIe 1.0 x16.

2005: R500 und erstmals PCIe

Im Oktober 2005 startete die R500-GPU-Serie. Mit dem 312 Millionen Transistoren schweren R520, der in 90 nm gefertigt wurde und 288 mm² maß, wurden High-End-Grafikkarten wie die Radeon X1800 XT (Test) bestückt. Seinerzeit erfolgte allmählich die Umstellung von AGP auf PCI Express. Es gab zu der Zeit Radeon mit AGP 8x wie auch neuerdings mit PCIe 1.0 x16.

Trotz vieler neuen technischen Features schaffte es diese Generation nicht an Nvidias GeForce vorbeizukommen. Zudem war der Stromverbrauch trotz der damals modernen 90-nm-Fertigung sehr hoch. Die Kühllösungen waren längst entsprechend aufwendiger geworden und oft schaufelten Radiallüfter die Abwärme aus dem Gehäuse.

2006: AMD übernimmt ATi

Ende Juli 2006 stand die Kaufabsicht von AMD offiziell fest. Der CPU-Hersteller wollte ATi für 5,4 Milliarden US-Dollar übernehmen und sich damit ein Standbein im GPU-Bereich sichern, die Kombination von CPU und GPU in einem Chip stand als Zukunftsvision im Raum.

Der Abschluss der Akquisition wurde schließlich am 25. Oktober 2006 vollzogen. Seitdem ist die Marke Radeon zu einem festen Bestandteil von AMD geworden und lebt in den Produkten der Radeon Technologies Group weiter. Die zunächst weiter genutzte Marke ATi ist aber längst aus dem Portfolio verschwunden. Im Sommer 2010 kündigte AMD den Wechsel von „ATi Radeon“ auf „AMD Radeon“ an.

2007: R600 eröffnet die TeraScale-Ära

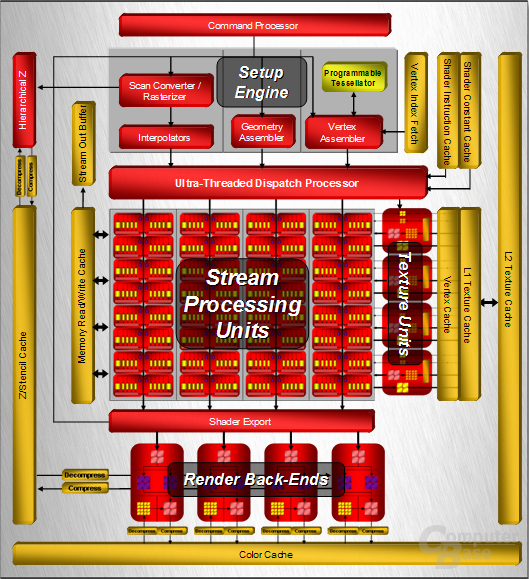

Alle zuvor genannten Radeon-GPUs setzten noch auf Architekturen mit fester Daten-Pipeline (Fixed-Pipeline). Ab R600 begann die Ära der TeraScale-Architektur mit Unified Shadern, wie sie auch Nvidia mit der Tesla-Architektur eingeführt hat. Fortan gab es keine separaten Pixel-, Vertex- oder Geometry-Shadereinheiten mehr. Stattdessen sind die Arithmetic Logical Units (ALU) dazu in der Lage, alle drei möglichen Berechnungsarten nacheinander auszuführen.

Technisch gesehen war diese Zeit von weiteren großen Umbrüchen geprägt, denn endlich kam auch DirectX 10.0 heraus. Zudem hielt bei Radeon Unterstützung für OpenCL und Video-Encoding Einzug.

Die Radeon HD 2900 XT (Test), so das neue Namensschema, war mit dem R600 mit 700 Millionen Transistoren bestückt, der mit 742 MHz arbeitete. Der 512 MB fassende GDDR3-Speicher lieferte am extrem breiten 512-Bit-Interface einen Durchsatz von über 100 GB/s. Dennoch hatte die HD 2900 XT im Duell mit Nvidias GeForce 8800 GTX/Ultra das Nachsehen.

Mit der Radeon HD 3870 (Test) gab es den Wechsel auf GDDR4-Speicher, aber auch eine Halbierung des Speicherinterface auf 256 Bit und am Ende nur wenig mehr Leistung gegenüber der HD 2900 XT.

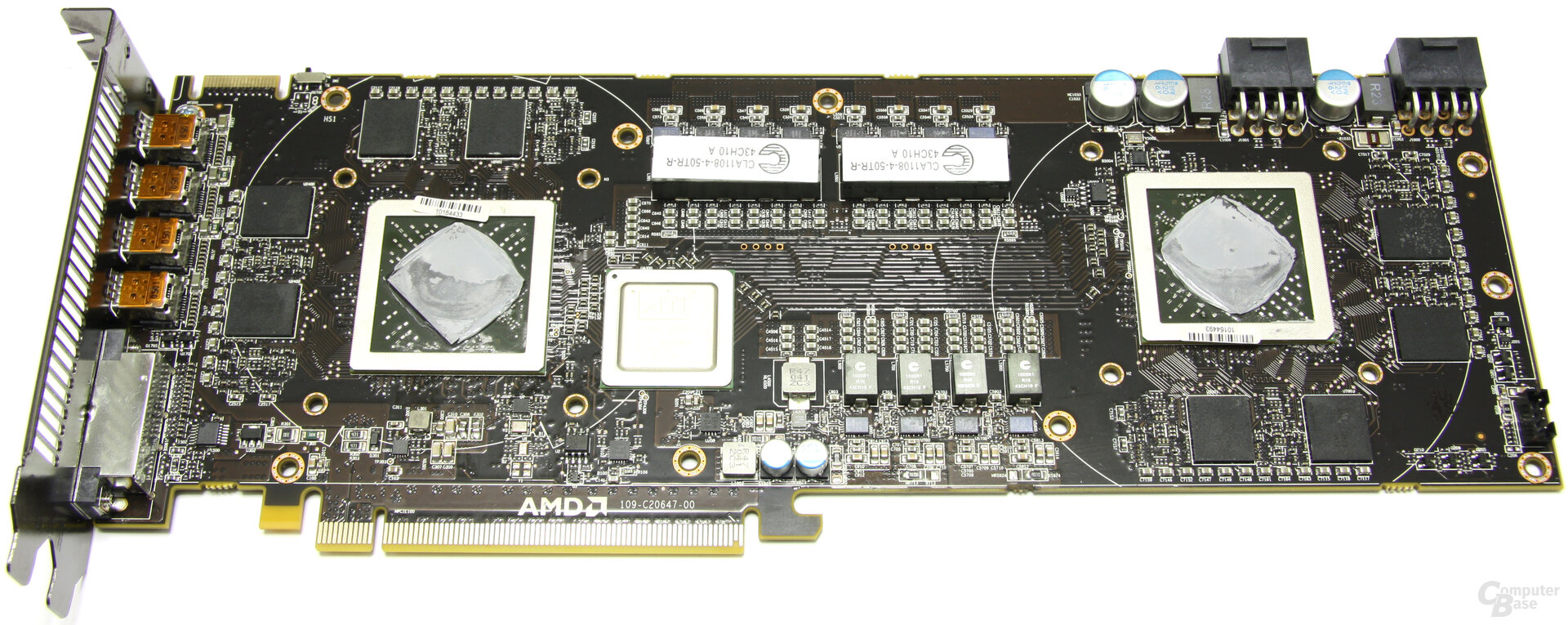

2008 setzte AMD bei der Radeon HD 3870 X2 (Test) einfach auf zwei GPUs des Typs RV670 und konnte so die GeForce 8800 Ultra zumindest schlagen und wieder die Leistungskrone erreichen. Nvidia tat es aber gleich und schlug kurz darauf mit der GeForce 9800 GX2(Test) und doppeltem G92 erfolgreich zurück.

Eine absolute Kuriosität stellte die HD 3450 X2 von Jaton dar. Zwei günstige Chips wurden auf einer Karte vereint, um die Anzahl der ansteuerbaren Monitore auf vier zu erhöhen. Diese Karte konnte auch im Crossfire Betrieb eingesetzt werden.

2008: Radeon HD 4870 (X2)

Zunächst einzeln als Radeon HD 4870 (Test) und später erneut im Doppelpack als Radeon HD 4870 X2 (Test) ließ AMD die RV770-GPU antreten. Die in 55 nm gefertigte GPU brachte es einzeln auf 956 Millionen Transistoren und 256 mm². Die Zahl der ALUs wurde gegenüber den Vorgängern auf 800 erhöht, also mehr als verdoppelt.

Dementsprechend fiel auch die Leistungssteigerung groß aus, genau genommen war sie riesengroß: Die HD 4870 war mit hohen Qualitätseinstellungen doppelt so schnell wie eine HD 3870. Für die Leistungskrone reichte es dennoch nur im Doppelpack.

2009: DirectX11-Weltpremiere mit HD 5870

Im September 2009 brachte AMD mit der Radeon HD 5870 (Test) die weltweit erste Grafikkarte mit Unterstützung für DirectX 11 auf den Markt. Gegenüber der HD 4870 wurden die Shader-Einheiten nochmals verdoppelt und schnellerer GDDR5-Speicher sorgte für mehr Durchsatz.

Die Cypress-GPU (40 nm, 334 mm²) verhalf der Grafikkarte bei hohen Auflösungen und Qualitätseinstellungen zu einem knappen Sieg über die GeForce GTX 295 mit Doppel-Chip.

2010: Northern Islands enttäuscht

Die letzten Vertreter der TeraScale-Ära waren die GPUs der Familie Northern Islands. Dazu zählten Radeon HD 6870 (Test) und Radeon HD 6970 (Test). Für High-End reichte es in dieser Generation nicht mehr und letztlich enttäuschten die Modelle.

2011: Graphics Core Next kommt

In diesem Jahr erschien zunächst noch einmal ein Doppelpack: Die Radeon HD 6990 (Test) packte zwei Cayman-Chips unter einen ungewöhnlichen Kühler mit zentral sitzendem Radiallüfter, der mächtig für Radau sorgte.

Es folgte manches überraschende Mittelklasse-Modell (HD 6790), bis es kurz vor Weihnachten wieder an der Spitze spannend wurde. Die Radeon HD 7970 (Test) eröffnete den Reigen der neuen Architektur Graphics Core Next (GCN).

Mit dem 4,31 Milliarden Transistoren schweren Tahiti-Chip (28 nm, 365 mm²) und 3 GB GDDR5 gelang ein ordentlicher Leistungssprung an die Spitze der Single-GPU-Charts. Nur Dual-GPU-Lösungen waren schneller.

2013: GCN2 überzeugt erst mit Hawaii

Die zweite Generation der GCN-Architektur machte auf der Radeon HD 7790 (Test) den eher unauffälligen Anfang als Lückenfüller.

Im September 2013 folgte dann die breite Einführung mit einem neuen Namensschema: Mit Radeon R7 260X, R9 270X und 280X waren die Produktnummern wieder dreistellig. Die Grafikkarten mit Codenamen von Südseeinseln brachten aber nichts viel Neues mit.

Erst das Flaggschiff Radeon R9 290X (Test) mit der für Radeon-Verhältnisse riesigen, 438 mm² messenden Hawaii-GPU sorgte wieder für Aufsehen und eine echte Antwort auf Nvidias GeForce GTX Titan, die aber leiser und effizienter war.

2015: Fiji-GPU setzt auf HBM

In puncto Chipgröße sollte es für AMD Radeon aber noch viel Luft nach oben geben. Im Sommer 2015 kam mit der Fiji-GPU ein wahrer Riese von 596 mm² heraus. Der in 28 nm bei TSMC gefertigte Chip besaß 8,9 Milliarden Transistoren und 4.096 Shader-Einheiten.

Ein absolutes Novum war die Kombination mit High Bandwidth Memory (HBM), der direkt neben der GPU auf dem Package sitzt. Wermutstropfen: Er war nur 4 GB groß, was noch zu Lebzeiten immer häufiger zum Flaschenhals wurde.

Die Fiji-GPU wurde auf der Radeon R9 Fury (leicht abgespeckt), der R9 Fury X mit AiO-Wasserkühler sowie der winzigen R9 Nano eingesetzt.

2016: Radeon RX und Polaris

Zur vierten Generation der GCN-Architekturen gehört Polaris, mit der wieder ein neues Namensschema eingeführt wurde: Erstmals hießen Radeon „RX“. Auf der Radeon RX 480 (Test) saß Polaris 10 mit für diese Zeit enormer Packdichte von 24,6 Millionen Transistoren pro mm². Die 14-nm-FinFET-Fertigung bei Globalfoundries sorgte zudem für enorme Effizienzverbesserungen. Doch in diesem Punkt war Nvidia Pascal (GTX 1070) zu jener Zeit nicht zu schlagen und dabei noch deutlich schneller.

2017: Vega bleibt hinter Erwartungen

In jenem Jahr trugen GPU-Architektur und Grafikkarte den gleichen Namen: Vega. Der Fiji-Nachfolger sollte AMD wieder ins High-End-Segment zurückbringen und brachte die Radeon RX Vega 64 (Test) zumindest in etwa auf Augenhöhe der GeForce GTX 1080. Allerdings brauchte es dafür fast doppelt so viel Energie beim Spielen und der Chip blieb mit schwankender Leistung hinter den Erwartungen zurück.

2019: Navi folgt auf unrühmliche Radeon VII

„Zu laut, zu langsam und zu teuer“ – selten hat ComputerBase in einem Grafikkartentest so deutlich negative Worte direkt im Titel gewählt (und selten gab es dafür so große Kritik). Doch die Radeon VII (Test) mit Vega-20-GPU aus dem Profibereich und 16 GB HBM2 versagte auf ganzer Linie. Trotz des ambitionierten Preises oberhalb der GeForce RTX 2080 war sie etwas lansamer als das Nvidia-Pendant und dabei noch extrem laut unter Last. Selbst in der Community griffen nur sehr wenig Nutzer zu.

Doch dann sollte er wieder kommen, der Lichtblick nach langer Durststrecke mit Mittelklasse-Wiederverwertung und kläglichem High-End: Im Sommer 2019 kamen Radeon RX 5700 und 5700 XT (Test). Auf Basis der ersten RDNA-Architektur lieferten die Navi-Grafikchips ein überzeugendes Gesamtpaket aus Leistung, Effizienz und Preis. Die Oberklasse wurde damit aber nicht bedient.

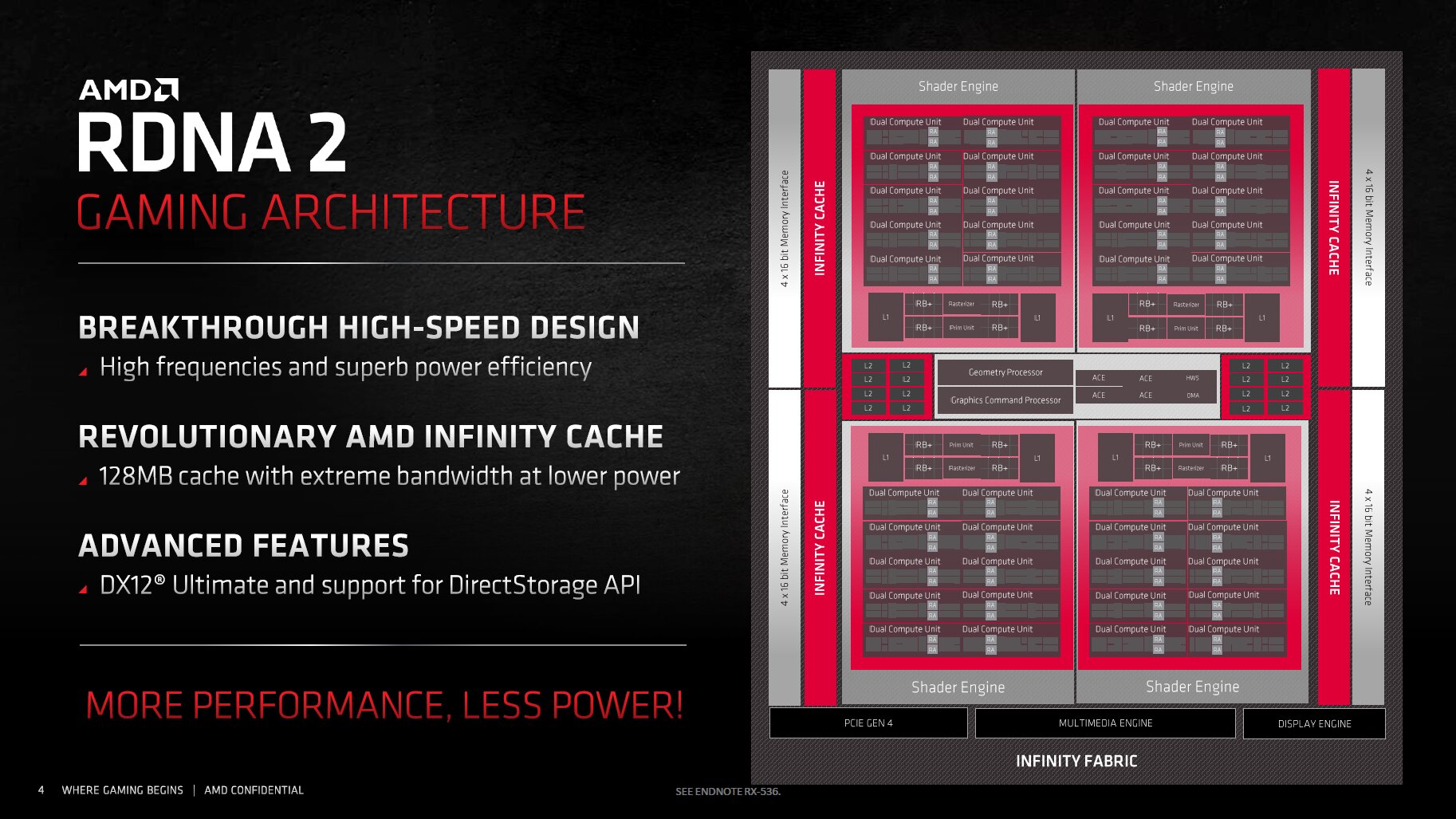

2020: Mit Big Navi zurück im High-End

Ganze sieben Jahre nach der Radeon R9 290X meldet sich AMD erst wieder in der Oberklasse zurück. Navi 21 alias „Big Navi“, eine 520 mm² große 7-nm-GPU mit RDNA-2-Architektur, hievte die Radeon RX 6800 (XT) auch dank der Geheimwaffe Infinity Cache, hohen Taktraten und Raytracing-Einheiten wieder ins obere Produktsegment und bot GeForce RTX 3070 und RTX 3080 die Stirn.

Mit der nachgereichten RX 6900 XT (Test) und dem Vollausbau von Navi 21 gelang es sogar fast, ohne RT die GeForce RTX 3090 vom Thron zu stürzen.

2022: RDNA 3 spielt weiter mit

Zwei Jahre später folgte der Nachfolger Navi 31 mit RDNA 3 auf der Radeon RX 7900 XTX (Test), die mit 24 GB GDDR6 Nvidias GeForce RTX 4080 bei Spielen mit klassischer Rasterung einfing. Bei inzwischen häufigeren Raytracing-Titeln hatte Nvidia aber weiter klar die Nase vorn und spielte mit der RTX 4090 in einer ganz anderen Liga.

Im Jahr 2023 sorgten dann RX 7800 XT und RX 7700 XT (Test) für mehr Konkurrenz in der Mittelklasse. Bei der Software verlor AMD trotz Updates von FSR auf FSR 2 und FSR 3 aber immer weiter den Anschluss gegenüber Nvidia.

2025: RDNA 4 als Revolution

Lag Radeon bisher bei Raytracing weit hinter Nvidia zurück, änderte sich dies mit der aktuellen Architektur RDNA 4. Die Radeon RX 9070 (Test) kann so die GeForce RTX 5070 auch beim Raytracing schlagen und sorgte für eine Überraschung.

RDNA 4 macht im Grunde alles besser als RDNA 3: Sei es Raster-Rendering, Raytracing, AI, FSR 4, Energieeffizienz oder die Videoeinheiten. Überall sind ordentliche bis hin zu riesige Fortschritte zu erkennen, lautete das Fazit. Doch reicht es auch mit der RX 9070 XT nicht für die Oberklasse.

Dem High-End-Sektor hatte AMD zuvor schon eine Absage erteilt. Dennoch träumt die Gerüchteküche nun von einer RX 9080 XT...

Eure Radeon-Historie?

Was ist eure Radeon-Historie? Mit welchen Modellen hattet ihr Kontakt oder welche hättet ihr gerne euer Eigen genannt? Die Redaktion freut sich über jede Anekdote in den Kommentaren zu diesem Bericht.

Dieser Artikel war interessant, hilfreich oder beides? Die Redaktion freut sich über jede Unterstützung durch ComputerBase Pro und deaktivierte Werbeblocker. Mehr zum Thema Anzeigen auf ComputerBase.