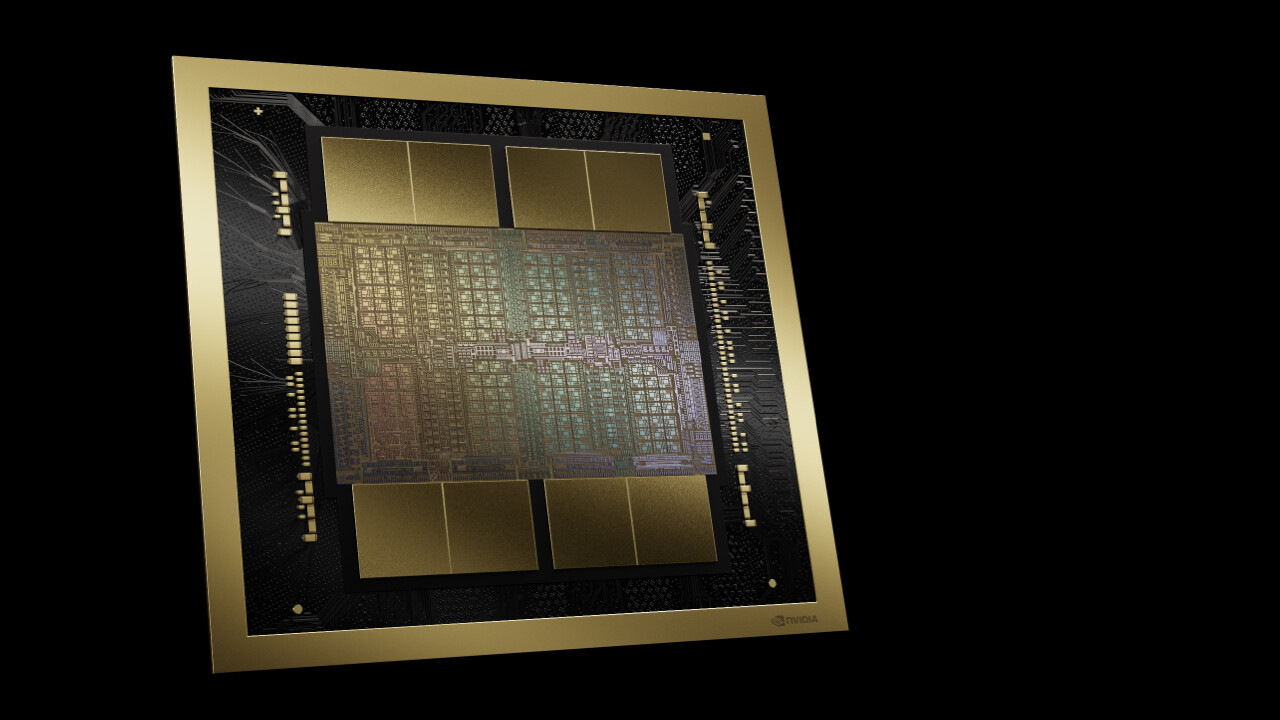

Wie viel kostet Blackwell?: Nvidias CEO relativiert „30.000 bis 40.000 USD“-Aussage

„Er hat 30.000 bis 40.000 US-Dollar gesagt!“, scholl es am Dienstag durch die Medienlandschaft. Gemeint war eine Aussage zum Preis der neuen Nvidia-Blackwell-GPUs B100 und B200 im US-Fernsehen. Dass sich CEO Jensen Huang überhaupt zu einer Aussage hinreißen ließ, kam einer Überraschung gleich. Kurz darauf hat er sie relativiert.

Es gibt keinen öffentlichen Listenpreis

Grundsätzlich nennt Nvidia keine Listenpreise für die eigenen HPC-CPU, was wenig überrascht, denn das Marktumfeld beziehungsweise die mit den High-Performance-Computing-Produkten umgesetzten Projekte bestehen aus mehr als der GPU beziehungsweise Grafikkarte und reicht von kleineren Abnehmern bis hin zu Firmen wie Meta, die bis Ende 2024 350.000 Hopper-GPUs einsetzen werden. Nicht einmal für die GPUs, die auf separat verkauften GeForce-Grafikkarten landen, nennt Nvidia einen Preis. Lediglich den UVP, den OEMs, die Chips zum unbekannten Preis bei Nvidia einkaufen, nehmen sollten, setzt Nvidia öffentlich fest.

HPC-GPUs sind Teil eines Ganzen

Kurz nach seinem Interview bei CNBC, aus dem vielerorten „Blackwell kostet 30.000 bis 40.000 US-Dollar pro GPU“ abgeleitet wurde, hat Huang die eigene Aussage gegenüber Journalisten auf Nachfrage noch einmal in einen breiteren Kontext gesetzt.

Nein, er habe sich nicht auf das Preisschild für einzelne GPUs bezogen, die verkaufe Nvidia schlussendlich auch gar nicht. Stattdessen ginge es immer um Systeme, die neben der GPU weitere Bestandteile wie beispielsweise den NVLink sowie Software, aber auch die Integration und Optimierung im Rechenzentrum umfassen. Von Kunde zu Kunde seien die Anforderungen andere. Die 30.000 bis 40.000 US-Dollar seien daher als Total Cost of Ownership (TCO) zu verstehen, wobei fraglich bleibt, ob Huang damit die per Definition enthaltenen Betriebskosten ebenfalls gemeint hat.

Die Gesamtkosten liegen letztendlich pro GPU so hoch

Eine B200-GPU kostet Kunden auf der Rechnung für das gestellte System demzufolge keine 30.000 bis 40.000 US-Dollar, wenngleich Huang dabei bleibt, konkret keine Aussage zu deren Anteil an den TCO zu treffen. Aus der Luft gegriffen war die Aussage gegenüber CNBC dennoch nicht: Effektiv müssen Kunden 30.000 bis 40.000 US-Dollar TCO pro GPU für ein lauffähiges Blackwell-System aufbringen können.

Der Vergleich zum Vorgänger fällt schwer

Dass Nvidia mit Blackwell noch höhere Preise als mit Hopper durchsetzen wird, darf angenommen, kann aber nicht belegt werden. Handfeste Leaks, die optimalerweise basierend auf Rechnung oder Verträgen den von OEMs zu zahlenden effektiven Preis für eine HPC-GPU von Nvidia (zuletzt H100 oder H200, vormals A100) nannten, gab es bis dato noch nicht. Analysten gingen zuletzt davon aus, dass Hopper 25.000 bis 40.000 US-Dollar kostet – je nachdem, um welche Konfiguration mit wie viel Speicher und Leistung es sich handelte, oder in welchem System die GPUs bestellt wurden. Der eigentliche Startpreis soll aber eher mal bei 15.000 US-Dollar gelegen haben.

Metas Zielsetzung, bis Ende 2024 über 350.000 Hopper-GPUs in den AI-Rechenzentren zu verfügen, wurde auf dieser Basis zuletzt mit Investitionen von 9 bis 14 Milliarden US-Dollar bewertet.