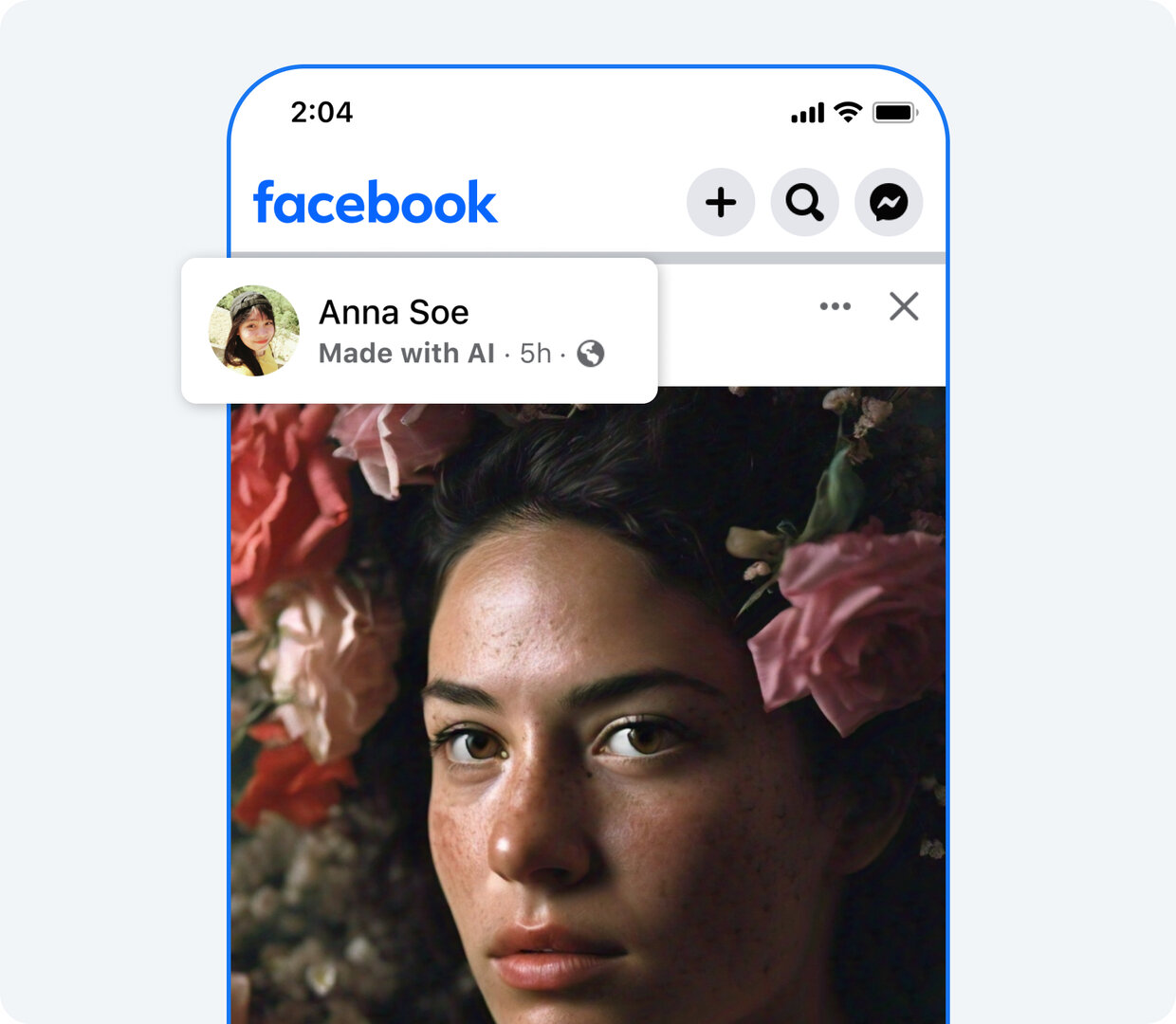

Künstliche Inhalte markieren: Facebook, Instagram und Threads erhalten AI-Label

Um mit modernen Bild- und Videogeneratoren erstellte oder veränderte Inhalte zu kennzeichnen, führt Meta ab dem Mai 2024 ein „Made-with-AI“-Label ein. Das gilt für alle sozialen Netzwerke des Konzerns, also Facebook, Instagram und Threads.

Für die Nutzer sollen also alle manipulierten Inhalte auf den ersten Blick sichtbar sein. Das Label erhalten Bilder sowie Audio- und Video-Inhalte automatisch, wenn diese von Metas Systemen erkannt werden oder Nutzer diese entsprechend markieren.

Die Erkennung läuft über die Wasserzeichen-Systeme, die praktisch alle führenden Anbieter verwenden. Entsprechende Ankündigungen erfolgten etwa von Adobe, Google, Microsoft und OpenAI. Auch die mit Metas AI-Funktionen erstellten Inhalte werden so markiert.

Neue Strategie als Reaktion auf neue Tools

Meta ändert die Strategie infolge von Rückmeldungen des Aufsichtsgremiums. Der bisherige Ansatz, der noch aus dem Jahr 2020 stammte, sei zu eng gefasst gewesen. Abgedeckt habe dieser nur solche Inhalte, die mit AI-Tools verändert oder erstellt worden sind, um den Eindruck zu erwecken, dass eine Person etwas sagte, was sie nicht gesagt hat. Es ging also um explizite Desinformation.

Mit der neuen Strategie werden sämtliche AI-Inhalte markiert, damit die Nutzer mehr Informationen erhalten. Nur weil es sich um synthetische oder veränderte Inhalte handelt, heißt es aber nicht, dass diese direkt ein Fall für die Moderation sind. Verstöße gegen die Nutzungsbedingungen und Community-Regeln prüft Meta weiterhin unabhängig davon, ob die Inhalte von AI-Tools oder einem Menschen stammen.

Im Bereich Desinformation spielen die AI-Inhalte dennoch eine besondere Rolle. Laut Meta kontrolliert ein Netzwerk mit rund 100 unabhängigen Faktenprüfern, ob AI-Inhalte irreführend oder falsch sind.

Vor allem in Kontext der Wahlen in diesem Jahr stehen sowohl die Entwickler der AI-Tools als auch die Betreiber der sozialen Netzwerke unter Druck. So findet im Juni die Europawahl statt, im Mittelpunkt der Diskussionen stehen aber insbesondere die amerikanischen Präsidentschaftswahlen im November. Rund 20 Tech-Konzerne haben sich daher bereits auf eine Kooperation verständigt, um die Wahlen vor dem Einfluss von KI-Manipulationen zu schützen. Meta ist einer dieser Konzerne.