The Last of Us Part II im Test: GPU-Benchmarks, Framepacing und VRAM

2/4Das Testsystem

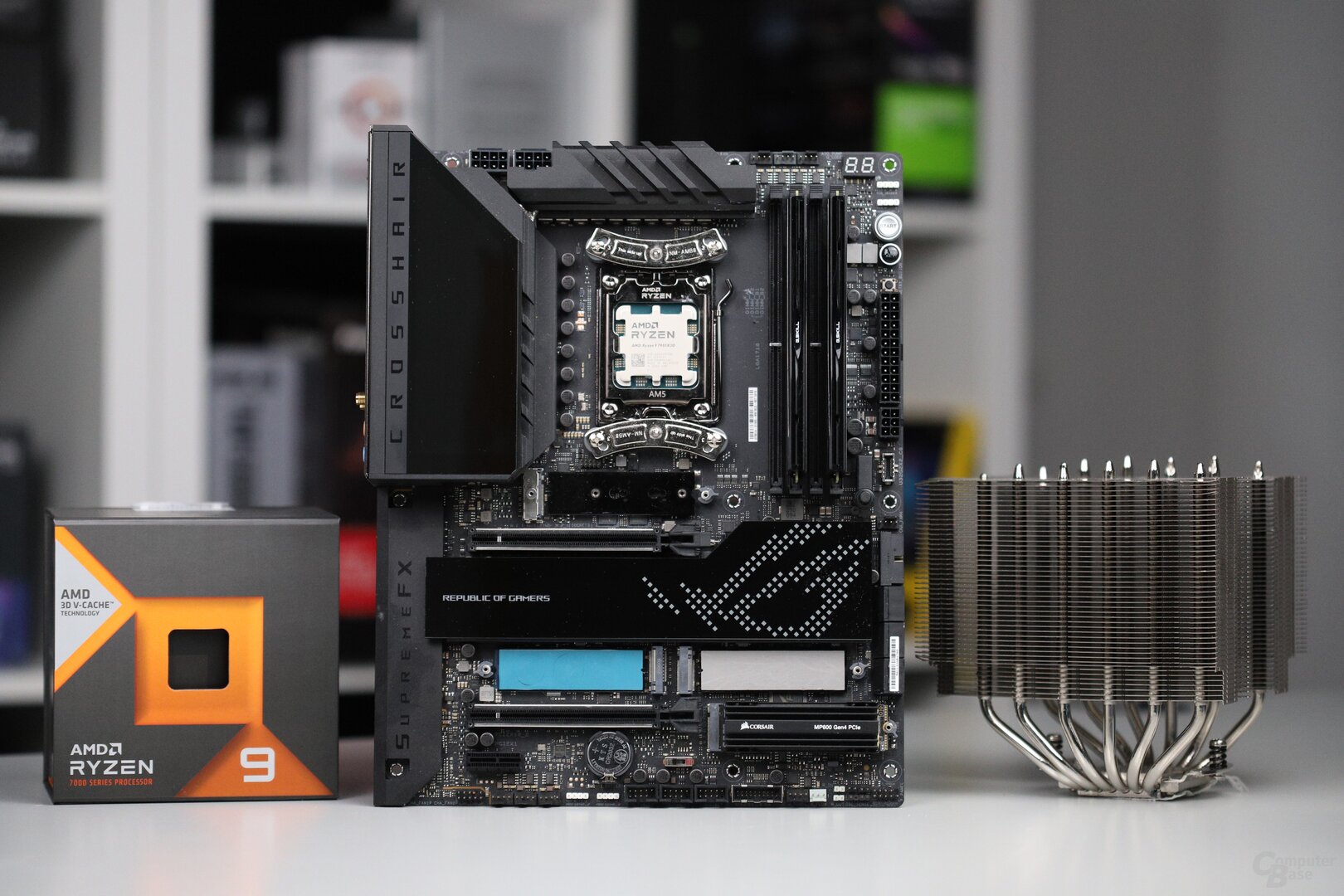

Alle Benchmarks werden auf einem AMD Ryzen 7 9800X3D (Test) durchgeführt, der mit den Standardeinstellungen betrieben wird. Als Mainboard ist das Asus ROG Crosshair X670E Hero (BIOS 2506) verbaut.

Die CPU wird von einem Noctua NH-D15S mit zentral installiertem 140-mm-Lüfter gekühlt. 48 GB Speicher (G.Skill TridentZ Neo, 2 × 24 GB, DDR5-6000, CL30-38-38-96) stehen dem Prozessor zur Verfügung. Windows 11 24H2 mit sämtlichen Updates und aktiviertem HVCI ist auf einer NVMe-M.2-SSD mit PCIe 4.0 installiert. Dasselbe gilt für das Spiel. Resizable BAR wird auf unterstützten Grafikkarten sowohl bei AMD als auch bei Nvidia sowie Intel genutzt.

| Treiberversion | Game Ready | |

|---|---|---|

| AMD Radeon | Adrenalin 25.3.2 | ✓ |

| Nvidia GeForce | GeForce 572.83 | ✓ |

| Intel Arc | 6651 | Nein |

| Auflösung | Grafikdetails |

|---|---|

| 2.560 × 1.440 | Sehr-Hoch-Preset, 16×AF, DLSS/FSR Quality |

| 3.440 × 1.440 | Sehr-Hoch-Preset, 16×AF, DLSS/FSR Quality |

| 3.840 × 2.160 | Sehr-Hoch-Preset, 16×AF, DLSS/FSR Quality |

Die Testszene und die unterschiedlichen Anforderungen an die Hardware

Je nach Gebiet gibt es bei der PC-Version von The Last of Us Part 2 drei verschiedene „Anforderungs-Profile“. Entweder ist

- die Szene anspruchsvoll für die GPU.

- die Szene anspruchsvoll für die CPU.

- die Szene anspruchsvoll für CPU und GPU.

So eine „Abwechslung“ bei der Last ist selten, für gewöhnlich weisen Spiele nur eins oder maximal zwei der Szenarien auf.

Rein GPU-dominierende Sequenzen sind in TLoU Part II am seltestenn. Natürlich hängt dies auch von den verbauten Komponenten ab, doch sind diese ausgeglichen, gibt es reine GPU-Last kaum. Primär tritt diese in Innengebäuden auf, die ohnehin mit einer sehr hohen Framerate laufen.

Die Testszene erzeugt gleichermaßen GPU- und CPU-Last

Die meiste Zeit werden GPU und CPU gleichermaßen belastet. Wann dies der Fall ist, ist schwer zu sagen, in mittelgroßen Umgebungen mit Wasser und einer ordentlichem Menge an Vegetation sind sie vermutlich am häufigsten anzutreffen. Genau so eine Szene entspricht auch der ComputerBase-Testsequenz, diese findet im Spielabschnitt "Die Seraphiten“ statt. Die Testsequenz ist anspruchsvoll, meistens läuft das Spiel schneller.

Primär CPU-lastige Szenen gibt es in dem Spiel genauso. Sequenzen mit vielen NPCs und generell große Levelabschnitte zählen dazu. In so einem Fall ist es bei einem ausgeglichenen System schwer möglich bis unmöglich, die Grafikkarte ans Limit zu bringen – die CPU entscheidet, wie viele FPS es gibt.

Benchmarks in WQHD, UWQHD und Ultra HD (Update)

60 FPS in The Last of Us Part II bei maximaler Bildqualität und inklusive Upsampling zu erreichen, ist auf dem Ryzen 7 9800X3D in der Benchmark-Szene mit verschiedenen Grafikkarten nicht schwer.

In WQHD gelingt dies ab einer GeForce RTX 4060, GeForce RTX 5070, Radeon RX 7700 XT oder RX 9070. Für UWQHD benötigt es genau die gleiche Hardware und für Ultra HD steigt diese nur geringfügig auf eine GeForce RTX 4070, GeForce RTX 5070, Radeon RX 7800 XT und Radeon RX 9070 an. Deutlich schneller muss es erst werden, wenn auf Upsampling verzichtet und stattdessen zum Beispiel DLAA und FSR Native genutzt wird.

Der Radeon RX 7600 bleiben die 60 FPS dagegen strikt verwehrt, was aber nicht an der Rechenleistung, sondern der Speicherausstattung liegt. 8 GB sind zu wenig für TLoU II, was Nvidias besseres Speichermanagement noch halbwegs kompensieren kann, das von AMD aber nicht. Dennoch empfiehlt die Redaktion auch auf einer GeForce, die Texturdetails bei einer 8-GB-Karte auch in Full HD um zwei Stufen auf Mittel zu reduzieren.

Überhaupt nicht klar kommt Intels erste GPU-Architektur, Alchemist. Die Arc A770 ist kaum schneller als die Radeon RX 7600, die den VRAM-Tod stirbt. Die Intel-Grafikkarte hat das Problem nicht, dennoch ist die GeForce RTX 4060 62 Prozent schneller. Der neuen Arc B580 schmeckt The Last of Us Part II deutlich besser, 26 Prozent mehr FPS gibt es als mit der Arc A770. Das bedeutet jedoch, dass die GeForce RTX 4060 mit einem Vorsprung von 28 Prozent immer noch klar schneller als die Arc B580 ist.

Vor allem RDNA 4 macht einen großen Sprung

The Last of Us Part II ist zwar ein „altes“ Spiel, profitiert aber dennoch überraschend deutlich von einer modernen GPU-Architektur. Bei Nvidia sind die Unterschiede noch gering. Blackwell ist zwar besser als Lovelace, dann aber eben doch nur etwas. Die GeForce RTX 5080 liefert 15 Prozent mehr FPS als die GeForce RTX 4080 Super, in AAA-Spielen sind es sonst nur 12 Prozent im Durchschnitt. Nochmal größer werden die Abstände in geringeren Auflösungen. In UWQHD liegt die neue GeForce 18 Prozent vor dem älteren Modell, 9 Prozent sind es im AAA-Schnitt.

AMDs RDNA-4-Generation macht einen großen Sprung nach vorne. Die Radeon RX 9070 XT liefert 10 Prozent mehr FPS als die Radeon RX 7900 XTX und letztere ist für gewöhnlich 6 Prozent schneller. Das macht in dem Spiel ein Plus von 16 Prozentpunkten gegenüber RDNA 3 aus.

Das hat zur Folge, dass AMDs RX-7000-Generation chancenlos gegenüber Nvidias RTX-4000-Serie ist. Die GeForce RTX 4080 Super ist 12 Prozent flotter unterwegs als die Radeon RX 7900 XTX, 4 Prozent sind es normalerweise; kein riesiger Unterschied, aber doch ein beachtlicher. Ganz anders verhält sich die Radeon RX 9070 XT, die in Ultra HD nur 4 Prozent langsamer als die GeForce RTX 5070 Ti ist, in anderen Spielen sind es durchschnittlich 7 Prozent – und in WQHD sowie UWQHD sind Radeon RX 9070 XT und GeForce RTX 5070 Ti sogar genau gleich schnell.

Die richtig großen GPUs tun sich schwer

Die richtig großen Grafikkarten haben es nicht so sehr mit The Last of Us Part II, was primär an dessen geringer GPU-Last und dem entsprechend früh auftretenden CPU-Limits liegt – auch auf einem Ryzen 7 9800X3D. So ist die GeForce RTX 4090 gerade einmal 19 Prozent flotter als die GeForce RTX 4080 Super und die GeForce RTX 5090 liefert nur 32 Prozent mehr Leistung als die GeForce RTX 5080. ~35 sowie ~50 Prozent sind hingegen übliche Werte.

60 FPS auf RTX 4060 und RX 7600 – was muss ich tun?

Die GeForce RTX 4060 überschreitet mit maximalen Grafikdetails sowie DLSS Quality auch in WQHD die 60-FPS-Marke, entsprechend wenig muss ausgehend von den Einstellungen im Benchmark geändert werden. Es ist jedoch eine Überlegung wert, die Texturdetails um eine oder zwei Stufen zu reduzieren, weil die GeForce RTX 4060 mit ihren 8 GB VRAM am Limit des Möglichen operiert, was bei langen Spiel-Sessions schnell zu viel (beziehungsweise zu wenig) werden kann.

Die Radeon RX 7600 bleibt dagegen klar unter der 60-FPS-Grenze in WQHD, mehr als 40 FPS gibt es nicht. Das liegt aber schlicht daran, dass die 8 GB auf einer Radeon mit dem halbierten PCIe-Interface zu wenig sind, hier herrscht Speichermangel vor. In dem Fall müssen die Texturdetails unbedingt um zwei Stufen auf Mittel reduziert werden, auch hohe Texturen sind für die AMD-Grafikkarte noch zu viel. Dasselbe gilt in Full HD, in dieser Auflösung erreicht die Radeon RD 7600 bei reduzierten Texturdetails auch 70 Bilder pro Sekunde.

Anstatt die Grafikdetails gibt es bessere Alternativen

Wer mehr FPS aus den Grafikkarten quetschen möchte, sollte dies nicht mit Hilfe der Grafikdetails versuchen. Denn nicht nur, dass zum Beispiel das LOD mit dem Mittel-Preset stellenweise furchtbar aussieht und Objekte direkt vor dem Spieler sichtbar die Detailstufen anpassen, darüber hinaus ist der Leistungsgewinn auch recht gering. Mittel anstatt maximale Grafik beschleunigt die GeForce RTX 4060 in WQHD um gerade einmal 20 Prozent, dafür muss auf viel Bildqualität verzichtet werden.

Effektiver ist es auf einer GeForce RTX DLSS in den Performance-Modus zustellen – dies sollte aber mit DLSS 4, nicht mit DLSS 3 gemacht werden. Dasselbe kann theoretisch auch auf einer Radeon gemacht werden, jedoch nur wenn FSR 4 zur Verfügung steht, was zum Beispiel nicht bei einer Radeon RX 7600 hilft. In dem Fall muss man sich für das kleinere Übel entscheiden (FSR 3.1 Performance oder geringere Grafikdetails), was jeder selbst ausprobieren sollte.

Frame Generation ist nur im CPU-Limit sinnvoll

The Last of Us Part II tut sich schwer mit Frame Generation, die sich im Test als eher nicht empfehlenswert heraus gestellt hat. Das Problem ist, dass DLSS Frame Generation im GPU-Limit es in TLoU II kaum schafft, die Framerate zu erhöhen. Das hat zur Folge, dass die Framerate um vielleicht 20 Prozent ansteigt, die Latenz aber zugleich deutlich schlechter wird, was sich negativ bei der Steuerung bemerkbar macht. FSR 3 Frame Generation hat das Ganze besser im Griff und schafft es mehr, die Framerate zu erhöhen. Aber auch mit der Technologie ist das Ergebnis nicht sonderlich gut.

Ganz anders schaut es in Szenen aus, wo der Prozessor limitiert – dann kann Frame Generation das volle Potenzial ausfahren und auch DLSS 3 FG schafft mal eben doppelt so viele FPS. Das sieht nicht nur sehr rund und flüssig auf dem Bildschirm aus, sondern fühlt sich auch so an.

Doch das Spiel besteht eben nicht nur aus CPU-limitierten Sequenzen. Und da ein andauerndes An- sowie Abschalten von Frame Generation nicht realistisch ist und vor allem maximal nervig wäre, lautet die Empfehlung der Redaktion, derzeit durchweg auf Frame Generation zu verzichten, egal ob die Technologie von Nvidia oder von AMD ist. Die einzige Ausnahme könnten unausgeglichene Systeme sein, die mit einer starken Grafikkarte, zugleich aber einem unterdimensionierten Prozessor ausgestattet sind.

Kein perfektes, aber ein gutes Frame Pacing in TLoU II

Die PC-Version von The Last of Us Part II kompiliert bei jedem neuen Level-Abschnitt im voraus kurz für wenige Sekunden Shader vorab, was auszureichen scheint. Shader-Kompilierungsruckler gibt es in dem Spiel nicht. Auch von Travsersal-Stotterern bleibt das Spiel weitgehend verschont. Weitgehend deswegen, da von Zeit zu Zeit für rund eine Sekunde spürbar ein neuer Kartenabschnitt nachgeladen wird. Das macht sich durch ein unrundes Spielgefühl bemerkbar, was aber nur sehr kurz auftritt und dies auch nicht allzu häufig.

Das Frame Pacing an sich macht vor allem auf einer AMD-Grafikkarte einen richtig guten Eindruck. Die Radeon RX 9070 XT erzeugt im Test fast schon eine geraden Strich bei den Frametimes, besser geht es kaum. Entsprechend fluffig fühlt sich das Spiel auch bei einer ausreichend hohen Framerate an.

Mit der GeForce RTX 5070 Ti ist die Bildausgabe etwas unrunder, was primär das letzte Drittel der Testsequenz betrifft. Es gibt einige kleine und mittelgroße Ausreißer bei der Bildausgabe, jedoch nichts problematisches. Verfügt der Monitor über eine variable Refreshrate, sind diese bei ausreichender Framerate nicht zu spüren.

Nach dem Start verliert das Spiel etwas „den Fokus“

The Last of Us Part II zeigt in der Review-Version, die laut den Entwicklern fast identisch zur Launch-Version sein soll, ein merkwürdiges Verhalten, das vor allem auf Nvidia-Grafikkarten auftritt. Nach dem Starten oder nach dem Wechseln einer Auflösung, läuft das Spiel oft nicht optimal. Die Frameraten sind nicht so hoch wie sie sein könnten und das Frame Pacing ist etwas unruhig. Die Unterschiede zum korrekten Zustand sind nicht riesig, aber durchaus zu spüren.

Dann hilft es, mittels Alt+Enter das Spiel aus dem Fokus von Windows zu holen und durch erneutes Drücken von Alt+Enter den Fokus wiederherzustellen. Die Framerate und Frametimes sind danach wieder so wie sie es sein sollten. Das Problem tritt nicht bei jedem Spielstart auf, gerade auf einer GeForce-Grafikkarte aber schon häufig. Auf einer Radeon ist dies eher selten der Fall und auch die Auswirkungen sind nicht so groß.

Mehr als 8 GB und alles ist kein Problem mehr

8 GB sind für maximale Texturdetails in The Last of Us Part II zu wenig. Die Radeon RX 7600 ruckelt bereits in Full HD spürbar, während die GeForce RTX 4060 und die GeForce RTX 4060 Ti 8 GB dies auf den ersten Blick noch problemlos schaffen. Jedoch ist es fraglich, ob dies auch bei einer längeren Spiel-Session noch der Fall ist, darüber hinaus darf ja keine Grafikoption geändert werden – sonst läuft der Speicher über, was ein Zeichen ist, dass der VRAM bereits rappelvoll ist. Entsprechend lautet die Empfehlung der Redaktion, maximale Texturdetails auch in Full HD erst ab 12 GB VRAM zu nutzen. Grafikkarten mit 8 GB sollten die Texturdetails um 2 Stufen reduzieren, GPUs mit 10 GB hat die Redaktion dagegen nicht ausprobiert.

12 GB ist genug für jegliche Lebenslage, auch in Ultra HD haben sich keinerlei Probleme mehr gezeigt, inklusive Umschalten von Optionen und Frame Generation – die bei 8-GB-Grafikkarten die Performance auch nach unten gehen lässt.