1. Meine aktuelle Hardware:

Ich habe meine RX 6900 gegen eine RTX 4080 super getauscht und habe nun ein Problem mit Windows Anwendungen (nicht mit Games)

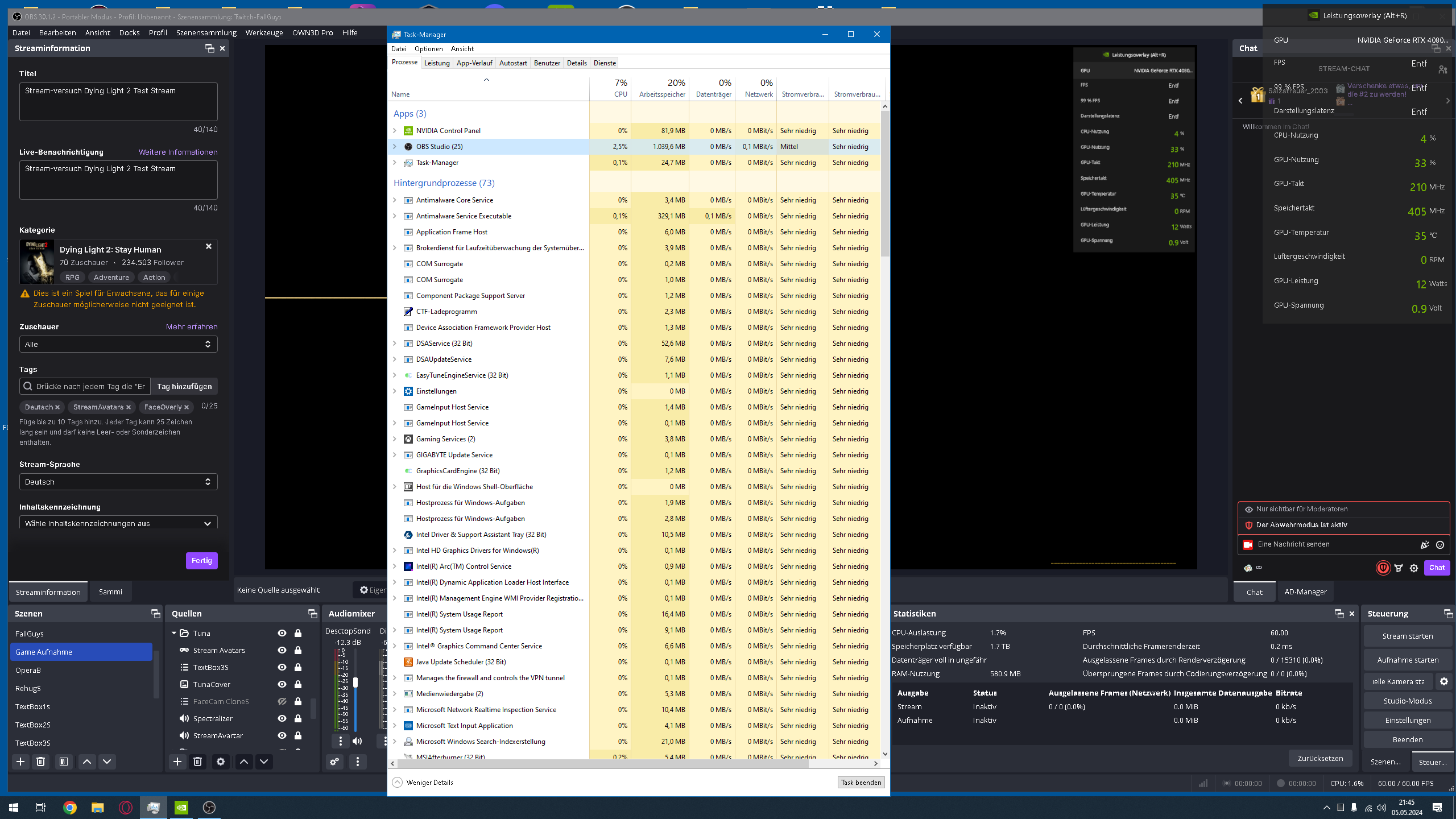

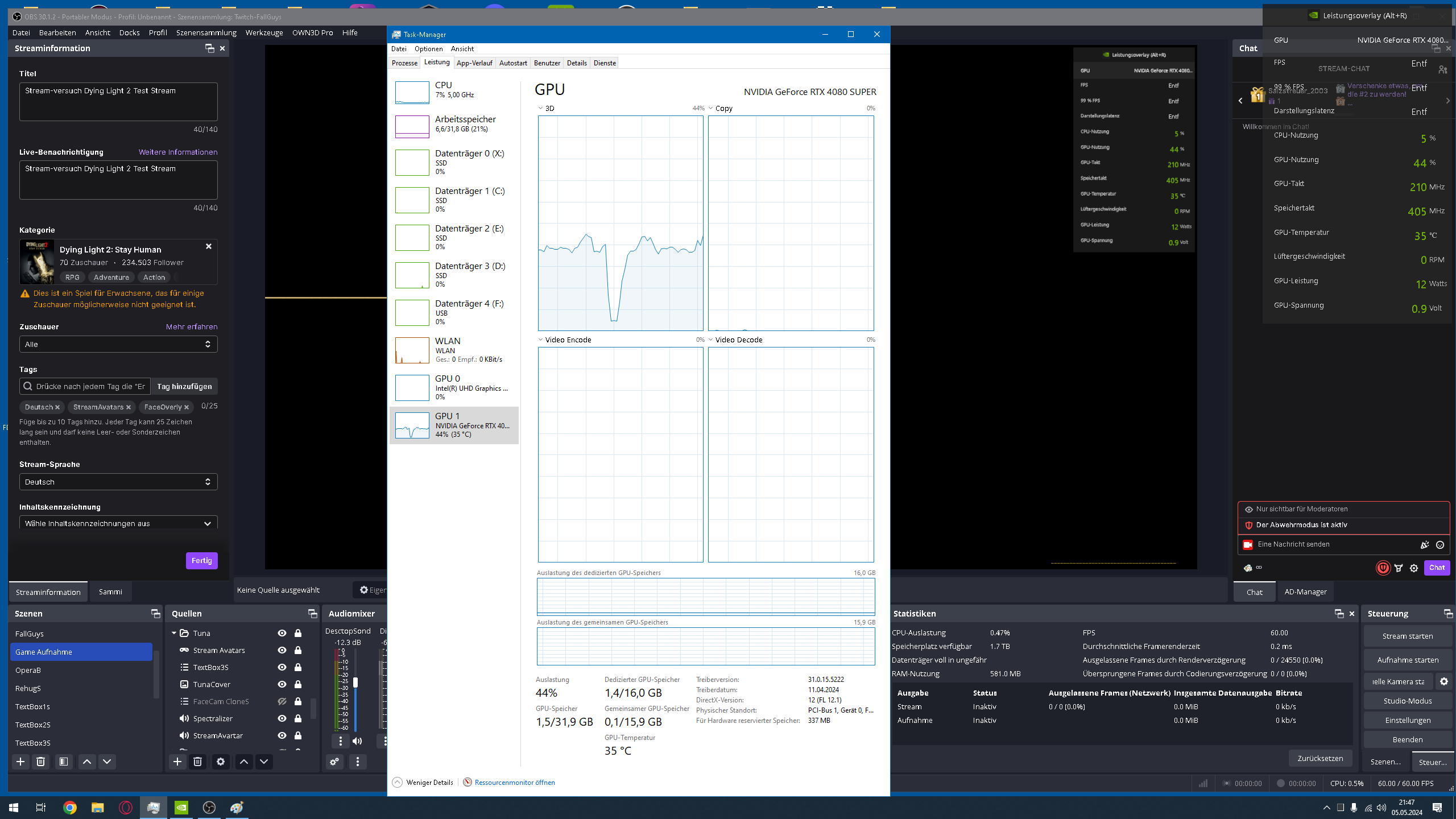

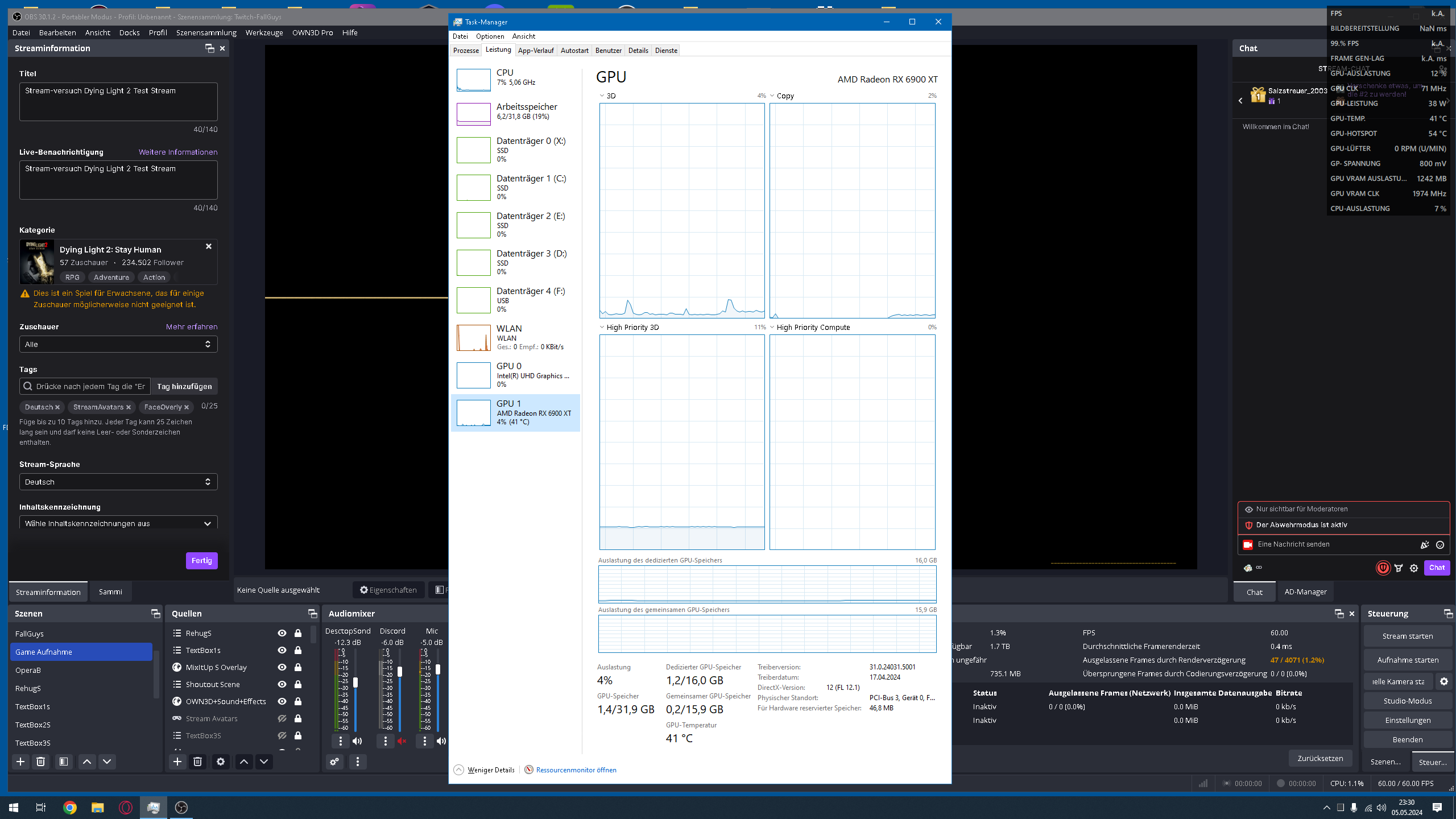

Wenn z. B. OBS gestartet ist, steigt die 3D-Auslastung der 4080 auf 40-70%. Wann Snap Camera gestartet ist (ohne ein Overlay) nimmt sich das Problem ca. 30% der 4080. Zuvor hatte ich die RX 6900 im Einsatz und da verbraucht OBS nur 6% und Snap Camera nur 10%.

Ich habe an System und an der Software nichts geändert, es wurde nur die Grafikkarte ausgetauscht und natürlich der aktuelle Treiber (552.22-desktop-win10-win11-64bit-international-dch-whql.exe) installiert.

Wieso verbraucht OBS Studio auf einer RTX soviel mehr Leistung als auf eine RX Karte? Und kann man da was gegen tun?

So sieht es mit der 4080 aus:

Und so mit der RX 6900:

- Prozessor (CPU): I4 13600K

- Arbeitsspeicher (RAM): 32 GB DDR5 6000 CL 30

- Mainboard: Gigabyte Z790 AORUS ELITE AX (rev. 1.x)

- Netzteil: Corsair RM850x

- Gehäuse: x

- Grafikkarte: RTX 4080 super Founders Edition / Powercoler RX 6900 XT Red Devil

- HDD / SSD: M.2 SSd´s

Ich habe meine RX 6900 gegen eine RTX 4080 super getauscht und habe nun ein Problem mit Windows Anwendungen (nicht mit Games)

Wenn z. B. OBS gestartet ist, steigt die 3D-Auslastung der 4080 auf 40-70%. Wann Snap Camera gestartet ist (ohne ein Overlay) nimmt sich das Problem ca. 30% der 4080. Zuvor hatte ich die RX 6900 im Einsatz und da verbraucht OBS nur 6% und Snap Camera nur 10%.

Ich habe an System und an der Software nichts geändert, es wurde nur die Grafikkarte ausgetauscht und natürlich der aktuelle Treiber (552.22-desktop-win10-win11-64bit-international-dch-whql.exe) installiert.

Wieso verbraucht OBS Studio auf einer RTX soviel mehr Leistung als auf eine RX Karte? Und kann man da was gegen tun?

So sieht es mit der 4080 aus:

Und so mit der RX 6900: