sz_cb

Lieutenant

- Registriert

- Jan. 2020

- Beiträge

- 724

Hallo liebes Forum,

Ende Februar 2024 habe ich mein AM4-System (5900X, 64 GB RAM, GTX 1660Super) ersetzt. Und das nicht, weil mir das System zu langsam gewesen wäre...

Einer der Gründe für den Umstieg war, dass ich mir ein Jahr zuvor einen Laptop mit Ryzen 7 Pro 6850U zugelegt hatte und gesehen habe, wie effizient die monolithischen APUs von AMD sind. Während mein Desktop im Leerlauf direkt nach dem Start und ohne Hintergrundprozesse bestenfalls 50 Watt verbraucht hat, kam mein Laptop mit 2,2 Watt (inkl. 14"-Bildschirm) aus. Sobald auch nur ein Browser-Fenster offen war, stieg der Verbrauch meines Desktop-PCs auf über 70 Watt an. Das empfand ich von Beginn an als völlig absurd. Der Laptop öffnete mir sozusagen die Augen.

Der zweite Grund war, dass mein Laptop und sämtliche andere IT im Haushalt mit Linux lief - lediglich mein Desktop-PC baute noch auf Windows. Ich hatte den OS-Wechsel stets aufgeschoben, weil ich an dem PC meine Brötchen verdiene und täglich gut und gerne 12-16 Stunden daran verbringe.

Dann wurde der 8700G veröffentlicht und ich dachte mir: Das könnte die Gelegenheit sein! Wenn ich "upgrade", muss ich wegen AM5 ein komplett neues System aufbauen: neues Board, neuer RAM. Also sprach nichts dagegen, parallel zum bestehenden Desktop das neue System zu installieren. Gedacht, getan!

Board, CPU und RAM habe ich neu gekauft, den Rest konnte ich vorübergehend mit Komponenten aus der Wühlkiste bestücken. Da die CPU gerade erst auf den Markt kam, wollte ich sicherstellen, dass der Linux-Kernel die CPU kennt, deshalb habe ich mich für Nobara entschieden, was mir als brauchbarer Kompromiss aus "Point release" und "Rolling release" erschien. Die Installation und der Datentransfer verliefen überraschend problemlos. Binnen einer Woche konnte ich im Gehäuse die alten durch die neuen Komponenten ersetzen und hatte direkt zum Start ein funktionierendes Produktivsystem, inkl. aller virtuellen Maschinen, Entwicklungsumgebungen, neuen Serverzugängen usw..

"Warum dauerte das eine ganze Woche?"

Nunja, abgesehen davon, dass ich "nebenher" arbeitete, wäre ich nicht ich, wenn ich nicht versuchen würde, die Systemeffizienz zu optimieren

"Aber der 8700G ist doch sehr effizient!"

Kurz gesagt: Jain.

Im Auslieferungszustand mag der 8700G effizient erscheinen, doch im Grunde ist der 8700G ein Chip aus dem mobilen Bereich, der für den Desktop mit der Brechstange hochgepusht wurde. Es bot sich also geradezu an, ihn in Sachen Effizienz zu optimieren.

"Aber vom 5900X zum 8700G zu wechseln ist in Sachen Performance doch ein Downgrade!"

Das stimmt, auf dem Papier. Zum Zocken kam ich mit den Jahren immer weniger. Zudem haben die aufgerufenen Preise selbst für Mittelklasse-GPUs und die gefühlt immer langweiligeren neuen Spiele auch nicht gerade dafür gesorgt, den Spieltrieb wieder zu entfachen. Hinzu kam, dass sich meine erwerbsmäßigen Tätigkeiten immer mehr in Richtung Web-Backend und -Frontend sowie Fernwartung verlagerten und der 5900X dafür völlig übertrieben ist. Das und die laufenden (Strom-)Kosten bei 12-16 Stunden täglicher Nutzung (bei meist recht geringer Systemlast) waren mir Gründe genug. Vermisse ich im Alltag die potenzielle Mehrleistung des 5900X? Absolut nicht. Stattdessen erfreue ich mich daran, dass der 8700G jetzt auch den AV1-Codec per Hardware encoden kann. Alles andere läuft genauso wie zuvor. Nur eben mit deutlich gesenktem Stromverbrauch, geringerer Abwärme und geringerem Kühlaufwand. Da wir im Dachgeschoss wohnen, ist das ein gar nicht so unerheblicher Faktor.

Mein aktuelles System

Im Leerlauf verbraucht der PC zwischen 24 und 26 Watt (an der Steckdose). Ausgehend davon, dass das Deaktivieren des XMP/EXPO-Profils 10-12 Watt sparen soll, müsste mein PC nach dem Deaktivieren nur noch ca. 14 Watt im Leerlauf verbrauchen. Das macht er aber nicht: Der Verbrauch ist auch mit dem Standard-JEDEC-Profil (4800 MT/s, 1,1 Volt) schwankend zwischen 24 und 26 Watt. Ich kann diese im Netz herumgeisternde Grenze von 6000 MT/s demnach nicht bestätigen. Weshalb das bei den meisten 8000G-Systemen anders ist als bei meinem System, kann ich leider nicht erklären...

Mein 8700G ist undervolted (-0,07 V) und zudem mittels PBO underclocked (-450 MHz), auf 45 Watt PPT gedeckelt (entspricht einer TDP von 33 Watt) und core optimized (-45). Nicht genutzte Komponenten des Mainboards sind im BIOS deaktiviert. Die iGPU-Settings sind auf "Auto", allerdings reserviere ich 8 GB des RAMs exklusiv für die iGPU, damit stets genug freier Speicher für kleinere, lokale KI-Sprachmodelle bzw. KI-Bildgeneratoren verfügbar ist). Spannungen für RAM, VDDG/VDDP & Co. sind entweder fest eingestellt oder mit einem negativen Offset versehen. RAM und CPU laufen selbstverständlich Prime-stable.

Verbrauch Gesamtsystem (Steckdose)

Verbrauch CPU-Package (turbostat)

Benchmark-Resultate

AIDA64 (Wine)

Cinebench R23 (Wine)

Geekbench 6.3 (nativ Linux)

Ich weiß nicht, wie hoch die Performance-Verluste durch die Windows-Emulation mit Wine sind, aber die Ergebnisse halte ich für mehr als ok, v.a. in Anbetracht des nahezu halbierten Verbrauchs. Performance verliert man durchs Untertakten nur im Singlecore. Im Multicore ist der Verlust vernachlässigbar. Durch die zusätzlichen Tuning-Maßnahmen kann die Performance sogar besser sein (siehe Geekbench). Und das bei fast halbiertem Verbrauch im Multicore (45 statt 88 Watt). Ein paar Prozentpunkte lässt man durch die Optimierungen mitunter liegen, aber wenn es mir um die ultimative Performance ginge, hätte ich mir nicht den 8700G gekauft.

Mein Fazit

Man merkt, dass der 8700G eigentlich aus dem mobilen Bereich stammt und für den Desktop ab Werk weit entfernt vom Sweetspot betrieben wird. Der 8700G kann jedoch durch etwas Tuning deutlich effizienter sein, als er ausgeliefert wird. Dass dies fast um den Faktor 2 geschieht, war für mich dann aber doch überraschend. Der PC ist in keiner Lebenslage hörbar und die CPU wurde im Sommer beim Video-Encoden schlimmstenfalls 60 °C warm. Und wenn ich tatsächlich mal Zocken will, geht das mit Abstrichen auch ganz gut (neulich habe ich mal wieder Metro 2033 Redux und Portal 2 angespielt).

Der Umstieg vom 5900X (+ GTX 1660S, Windows 10) zum 8700G (iGPU, Linux) war für mich die goldrichtige Entscheidung.

Wie sieht es bei euch aus? Habt ihr ähnliche oder ganz andere Erfahrungen gemacht? Könnt ihr APUs etwas abgewinnen?

Ende Februar 2024 habe ich mein AM4-System (5900X, 64 GB RAM, GTX 1660Super) ersetzt. Und das nicht, weil mir das System zu langsam gewesen wäre...

Einer der Gründe für den Umstieg war, dass ich mir ein Jahr zuvor einen Laptop mit Ryzen 7 Pro 6850U zugelegt hatte und gesehen habe, wie effizient die monolithischen APUs von AMD sind. Während mein Desktop im Leerlauf direkt nach dem Start und ohne Hintergrundprozesse bestenfalls 50 Watt verbraucht hat, kam mein Laptop mit 2,2 Watt (inkl. 14"-Bildschirm) aus. Sobald auch nur ein Browser-Fenster offen war, stieg der Verbrauch meines Desktop-PCs auf über 70 Watt an. Das empfand ich von Beginn an als völlig absurd. Der Laptop öffnete mir sozusagen die Augen.

Der zweite Grund war, dass mein Laptop und sämtliche andere IT im Haushalt mit Linux lief - lediglich mein Desktop-PC baute noch auf Windows. Ich hatte den OS-Wechsel stets aufgeschoben, weil ich an dem PC meine Brötchen verdiene und täglich gut und gerne 12-16 Stunden daran verbringe.

Dann wurde der 8700G veröffentlicht und ich dachte mir: Das könnte die Gelegenheit sein! Wenn ich "upgrade", muss ich wegen AM5 ein komplett neues System aufbauen: neues Board, neuer RAM. Also sprach nichts dagegen, parallel zum bestehenden Desktop das neue System zu installieren. Gedacht, getan!

Board, CPU und RAM habe ich neu gekauft, den Rest konnte ich vorübergehend mit Komponenten aus der Wühlkiste bestücken. Da die CPU gerade erst auf den Markt kam, wollte ich sicherstellen, dass der Linux-Kernel die CPU kennt, deshalb habe ich mich für Nobara entschieden, was mir als brauchbarer Kompromiss aus "Point release" und "Rolling release" erschien. Die Installation und der Datentransfer verliefen überraschend problemlos. Binnen einer Woche konnte ich im Gehäuse die alten durch die neuen Komponenten ersetzen und hatte direkt zum Start ein funktionierendes Produktivsystem, inkl. aller virtuellen Maschinen, Entwicklungsumgebungen, neuen Serverzugängen usw..

"Warum dauerte das eine ganze Woche?"

Nunja, abgesehen davon, dass ich "nebenher" arbeitete, wäre ich nicht ich, wenn ich nicht versuchen würde, die Systemeffizienz zu optimieren

"Aber der 8700G ist doch sehr effizient!"

Kurz gesagt: Jain.

Im Auslieferungszustand mag der 8700G effizient erscheinen, doch im Grunde ist der 8700G ein Chip aus dem mobilen Bereich, der für den Desktop mit der Brechstange hochgepusht wurde. Es bot sich also geradezu an, ihn in Sachen Effizienz zu optimieren.

"Aber vom 5900X zum 8700G zu wechseln ist in Sachen Performance doch ein Downgrade!"

Das stimmt, auf dem Papier. Zum Zocken kam ich mit den Jahren immer weniger. Zudem haben die aufgerufenen Preise selbst für Mittelklasse-GPUs und die gefühlt immer langweiligeren neuen Spiele auch nicht gerade dafür gesorgt, den Spieltrieb wieder zu entfachen. Hinzu kam, dass sich meine erwerbsmäßigen Tätigkeiten immer mehr in Richtung Web-Backend und -Frontend sowie Fernwartung verlagerten und der 5900X dafür völlig übertrieben ist. Das und die laufenden (Strom-)Kosten bei 12-16 Stunden täglicher Nutzung (bei meist recht geringer Systemlast) waren mir Gründe genug. Vermisse ich im Alltag die potenzielle Mehrleistung des 5900X? Absolut nicht. Stattdessen erfreue ich mich daran, dass der 8700G jetzt auch den AV1-Codec per Hardware encoden kann. Alles andere läuft genauso wie zuvor. Nur eben mit deutlich gesenktem Stromverbrauch, geringerer Abwärme und geringerem Kühlaufwand. Da wir im Dachgeschoss wohnen, ist das ein gar nicht so unerheblicher Faktor.

Mein aktuelles System

- CPU: Ryzen 7 8700G

- Mainboard: Gigabyte B650 Aorus Elite AX Rev 1.2 (BIOS FB2)

- RAM: 64 GB G.Skill Trident Z5 (2x 32 GB, DDR5-6000, 1,4 Volt)

- GPU: nur die iGPU

- SSDs (NVME): Samsung 980 Pro 2 TB & Teamgroup T-Force 4 TB

- Netzteil: Seasonic Prime Fanless 450 Watt

- Kühler & Lüfter: Noctua NH-D15s, insg. 6 Lüfter (Thermaltake TT Toughfan 12 PWM 120mm), zw. 450 und 600 RPM

- OS: Nobara Linux 40 (derzeitiger Kernel: 6.11.7)

- Soundkarte: Nuprime uDSD (extern via USB)

- Tastatur/Maus: Funk (mit jeweils eigenem USB-Empfänger)

- Monitore: 2x 27" WQHD, 60 Hz (1x HDMI, 1x DP)

- Netzwerk: angeschlossen an 2.5 GBit-Hub

Im Leerlauf verbraucht der PC zwischen 24 und 26 Watt (an der Steckdose). Ausgehend davon, dass das Deaktivieren des XMP/EXPO-Profils 10-12 Watt sparen soll, müsste mein PC nach dem Deaktivieren nur noch ca. 14 Watt im Leerlauf verbrauchen. Das macht er aber nicht: Der Verbrauch ist auch mit dem Standard-JEDEC-Profil (4800 MT/s, 1,1 Volt) schwankend zwischen 24 und 26 Watt. Ich kann diese im Netz herumgeisternde Grenze von 6000 MT/s demnach nicht bestätigen. Weshalb das bei den meisten 8000G-Systemen anders ist als bei meinem System, kann ich leider nicht erklären...

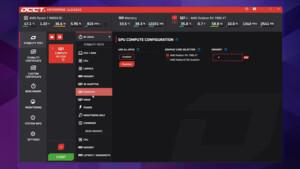

Mein 8700G ist undervolted (-0,07 V) und zudem mittels PBO underclocked (-450 MHz), auf 45 Watt PPT gedeckelt (entspricht einer TDP von 33 Watt) und core optimized (-45). Nicht genutzte Komponenten des Mainboards sind im BIOS deaktiviert. Die iGPU-Settings sind auf "Auto", allerdings reserviere ich 8 GB des RAMs exklusiv für die iGPU, damit stets genug freier Speicher für kleinere, lokale KI-Sprachmodelle bzw. KI-Bildgeneratoren verfügbar ist). Spannungen für RAM, VDDG/VDDP & Co. sind entweder fest eingestellt oder mit einem negativen Offset versehen. RAM und CPU laufen selbstverständlich Prime-stable.

Verbrauch Gesamtsystem (Steckdose)

- Leerlauf: zwischen 24 und 26 Watt

- Volllast: < 90 Watt

- Spiel (Portal 2, VSync 60 FPS): < 60 Watt

Verbrauch CPU-Package (turbostat)

- Leerlauf: 3,3 Watt

- Volllast: 44,9 Watt

Benchmark-Resultate

AIDA64 (Wine)

- RAM (Read): 63457 MB/s

- RAM (Write): 92770 MB/s

- RAM (Copy): 73844 MB/s

- RAM (Latency): 64,5 ns

Cinebench R23 (Wine)

- Singlecore: 1654 (92 % der Performance des 8700G im CB-Test)

- Multicore: 17253 (96 % der Performance des 8700G im CB-Test)

Geekbench 6.3 (nativ Linux)

- Singlecore: 2612 (97 % der Performance des 8700G im Geekbench Browser)

- Multicore: 14139 (102 % der Performance des 8700G im Geekbench Browser)

Ich weiß nicht, wie hoch die Performance-Verluste durch die Windows-Emulation mit Wine sind, aber die Ergebnisse halte ich für mehr als ok, v.a. in Anbetracht des nahezu halbierten Verbrauchs. Performance verliert man durchs Untertakten nur im Singlecore. Im Multicore ist der Verlust vernachlässigbar. Durch die zusätzlichen Tuning-Maßnahmen kann die Performance sogar besser sein (siehe Geekbench). Und das bei fast halbiertem Verbrauch im Multicore (45 statt 88 Watt). Ein paar Prozentpunkte lässt man durch die Optimierungen mitunter liegen, aber wenn es mir um die ultimative Performance ginge, hätte ich mir nicht den 8700G gekauft.

Mein Fazit

Man merkt, dass der 8700G eigentlich aus dem mobilen Bereich stammt und für den Desktop ab Werk weit entfernt vom Sweetspot betrieben wird. Der 8700G kann jedoch durch etwas Tuning deutlich effizienter sein, als er ausgeliefert wird. Dass dies fast um den Faktor 2 geschieht, war für mich dann aber doch überraschend. Der PC ist in keiner Lebenslage hörbar und die CPU wurde im Sommer beim Video-Encoden schlimmstenfalls 60 °C warm. Und wenn ich tatsächlich mal Zocken will, geht das mit Abstrichen auch ganz gut (neulich habe ich mal wieder Metro 2033 Redux und Portal 2 angespielt).

Der Umstieg vom 5900X (+ GTX 1660S, Windows 10) zum 8700G (iGPU, Linux) war für mich die goldrichtige Entscheidung.

Wie sieht es bei euch aus? Habt ihr ähnliche oder ganz andere Erfahrungen gemacht? Könnt ihr APUs etwas abgewinnen?

Randnotiz #1: Wie ich eingangs schrieb, wechselte ich Ende Februar zum 8700G. Etwa ein halbes Jahr später kam die Jahresabrechnung beim Strom: Wir haben knapp 170 kWh weniger verbraucht und bekommen 55 Euro zurück. Da es ansonsten im Haushalt keine Änderungen an Geräten oder Gewohnheiten gab, lässt sich der geringere Verbrauch durchaus dem PC zuschreiben. Mit dem Upgrade ging es mir natürlich nicht ums gesparte Geld bei der Stromabrechnung, aber es ist trotzdem nett, die Bestätigung vom Stromlieferanten zu bekommen.

Randnotiz #2: Das war mein erstes und letztes Mainboard von Gigabyte. 1. Die Linux-Ambitionen von Gigabyte sind praktisch nicht vorhanden, wodurch selbst das Auslesen der Lüfterumdrehungen zur Frickelei wird. Und 2. Wer um Himmels Willen erstellt bei Gigabyte das BIOS? Liegt das an AM5? Solch ein strukturelles Durcheinander habe ich bei keinem anderen Hersteller bisher erleben müssen. Selbst ein gutes halbes Jahr später finde ich konkrete Einstellungen nur, indem ich sämtliche Untermenüs durchforste. Dann sind manche Einstellungen redundant und ich muss sie an beiden für mich völlig abwegigen Stellen finden und ändern, damit sie übernommen werden. Die Hilfstexte, die - sofern überhaupt vorhanden - als Erklärung angezeigt werden, sind i.d.R. völlig unbrauchbar, weil sie den angezeigten Begriff oft mit sich selbst erklären ("XYZ" --> "Sets XYZ to Enabled or Disabled" ... aha!). Nicht falsch verstehen! Ich erwarte keine Enzyklopädie als Erklärung, aber wenigstens, wofür "XYZ" steht. Lüfterkurven sollen nach dem separaten Speichern angeblich ein BIOS-Update überstehen, was sie bei mir aber nicht taten. Das Laden früherer Einstellungen bringt einige Einstellungen zurück, aber rudimentäre Einstellungen (wie bspw. Virtualisierung) nicht - wtf?

Randnotiz #2: Das war mein erstes und letztes Mainboard von Gigabyte. 1. Die Linux-Ambitionen von Gigabyte sind praktisch nicht vorhanden, wodurch selbst das Auslesen der Lüfterumdrehungen zur Frickelei wird. Und 2. Wer um Himmels Willen erstellt bei Gigabyte das BIOS? Liegt das an AM5? Solch ein strukturelles Durcheinander habe ich bei keinem anderen Hersteller bisher erleben müssen. Selbst ein gutes halbes Jahr später finde ich konkrete Einstellungen nur, indem ich sämtliche Untermenüs durchforste. Dann sind manche Einstellungen redundant und ich muss sie an beiden für mich völlig abwegigen Stellen finden und ändern, damit sie übernommen werden. Die Hilfstexte, die - sofern überhaupt vorhanden - als Erklärung angezeigt werden, sind i.d.R. völlig unbrauchbar, weil sie den angezeigten Begriff oft mit sich selbst erklären ("XYZ" --> "Sets XYZ to Enabled or Disabled" ... aha!). Nicht falsch verstehen! Ich erwarte keine Enzyklopädie als Erklärung, aber wenigstens, wofür "XYZ" steht. Lüfterkurven sollen nach dem separaten Speichern angeblich ein BIOS-Update überstehen, was sie bei mir aber nicht taten. Das Laden früherer Einstellungen bringt einige Einstellungen zurück, aber rudimentäre Einstellungen (wie bspw. Virtualisierung) nicht - wtf?