Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

Du solltest ein Upgrade durchführen oder einen alternativen Browser verwenden.

8800 GT Overclocking

- Ersteller Cro-Mag

- Erstellt am

oMID.

Cadet 2nd Year

- Registriert

- Feb. 2008

- Beiträge

- 24

ZeroCoolRiddler

Vice Admiral

- Registriert

- Okt. 2006

- Beiträge

- 7.092

Das wäre ja mal traurig.

Nicht nur CPU-, sondern auch noch OS-abhängig. Na toll.

Ich hab unter Vista64 gebencht.

Edit:

Benchmarks durchgeführt. Vorläufige Ergebnisse siehe Sig.

Nicht nur CPU-, sondern auch noch OS-abhängig. Na toll.

Ich hab unter Vista64 gebencht.

Edit:

Benchmarks durchgeführt. Vorläufige Ergebnisse siehe Sig.

Zuletzt bearbeitet:

domidragon

Fleet Admiral

- Registriert

- Juli 2008

- Beiträge

- 11.531

@Michi was deine fragen zum SLI anbelangt... es spielt keine rolle welche Hersteller du mischt, da es immer ein un die selbe karte ist! die hersteller machen nur ein paar mod. und kleben ihren kleber rauf, oder eben flashen das bios und geben es al OC version raus.

ich habe auch 2 8800ultras im sli eine von ASUS eine von XFX. Takt spielt keine rolle, du musst nur GENAU den gleichen Grafikchip haben(G80, G84, G90. G92....) und es müssen gleich viel VRAM vorhanden sein, also kannst du nicht eine 256mb version mit einer 512mb version laufen lassen...

greez

ich habe auch 2 8800ultras im sli eine von ASUS eine von XFX. Takt spielt keine rolle, du musst nur GENAU den gleichen Grafikchip haben(G80, G84, G90. G92....) und es müssen gleich viel VRAM vorhanden sein, also kannst du nicht eine 256mb version mit einer 512mb version laufen lassen...

greez

domidragon

Fleet Admiral

- Registriert

- Juli 2008

- Beiträge

- 11.531

@ oMID: naja wenn du das fenster über den rand des monitors schiebst hast du schnell so viele punkte

oder hast du im fullscreen getestet, dann mach mal im window mod, bracuht mehr leistung ....

greez

oder hast du im fullscreen getestet, dann mach mal im window mod, bracuht mehr leistung ....

greez

Robmain

Lieutenant

- Registriert

- Jan. 2008

- Beiträge

- 603

@Domidragon

Das ist nicht ganz richtig und Komplett. Da die OC Karten teils mit vorsortierten Chips gefertigt werden.

D. h. eine OC Karte die mit 740 takten läuft kannst du mit einer default-karte auch nur bis zu deren max Takt (z. b. 680 Mhz) auch nur auf der Taktung des "schwächsten Gliedes" laufen lassen.

DH mit unter dass zB eine hochübertaktete Single G92 GPU mehr 3D Puinkte bekommt als ein default SLI Gespann, ergo kein Vorteil zu erlangen ist.

Weiterhin, haben die Karten auch (wenn Sie gleichen Herstellers, aber unterschiedlichen PRoduktionsdatums sind) unterschidliche Bios einstellungen zB für 2D und 3D Betrieb.

Die ersten 8800 GT von Ende 2007 sind alle auf kontinuierlichen 600 MHZ in allen Modi. Einige der neueren schalten im 2D Betrieb auf eine geringere Taktrate zurück um die Temperaturen und den Verbrauch geringer zu halten.

Ich habe dieses Problem bei mir gehabt und musste beide Bios synchron flashen, damit nicht die eine Karte die andere "mitzieht" wenn sie automatisch zurücktaktet.

Aber Du hast recht, wenn Du sagst, prinzipiell braucht man nur 2 gleiche Chips. Alles andere ist handarbeit zum Anpassen bis es läuft.

Das ist nicht ganz richtig und Komplett. Da die OC Karten teils mit vorsortierten Chips gefertigt werden.

D. h. eine OC Karte die mit 740 takten läuft kannst du mit einer default-karte auch nur bis zu deren max Takt (z. b. 680 Mhz) auch nur auf der Taktung des "schwächsten Gliedes" laufen lassen.

DH mit unter dass zB eine hochübertaktete Single G92 GPU mehr 3D Puinkte bekommt als ein default SLI Gespann, ergo kein Vorteil zu erlangen ist.

Weiterhin, haben die Karten auch (wenn Sie gleichen Herstellers, aber unterschiedlichen PRoduktionsdatums sind) unterschidliche Bios einstellungen zB für 2D und 3D Betrieb.

Die ersten 8800 GT von Ende 2007 sind alle auf kontinuierlichen 600 MHZ in allen Modi. Einige der neueren schalten im 2D Betrieb auf eine geringere Taktrate zurück um die Temperaturen und den Verbrauch geringer zu halten.

Ich habe dieses Problem bei mir gehabt und musste beide Bios synchron flashen, damit nicht die eine Karte die andere "mitzieht" wenn sie automatisch zurücktaktet.

Aber Du hast recht, wenn Du sagst, prinzipiell braucht man nur 2 gleiche Chips. Alles andere ist handarbeit zum Anpassen bis es läuft.

ZeroCoolRiddler

Vice Admiral

- Registriert

- Okt. 2006

- Beiträge

- 7.092

Mmhh...

Wenn ich jetzt an SLI mit Voltmod denke,...

Da läuft dem Benchmarker glatte der Sabber von´ner Backe.

PS: Hab heute endlich die 16K Marke im 06er geknackt.

Wenn ich jetzt an SLI mit Voltmod denke,...

Da läuft dem Benchmarker glatte der Sabber von´ner Backe.

PS: Hab heute endlich die 16K Marke im 06er geknackt.

ZeroCoolRiddler

Vice Admiral

- Registriert

- Okt. 2006

- Beiträge

- 7.092

Danke.

Das "Luder" zieht ziemlich viel. 1,315V unter Volllast!

Werde die nächsten Tage mal nen OCP-Mod machen, da diese mir ab und zu schon dazwischenfunkt.

Mal sehen was mit 1,4-1,45V so geht...

Das "Luder" zieht ziemlich viel. 1,315V unter Volllast!

Werde die nächsten Tage mal nen OCP-Mod machen, da diese mir ab und zu schon dazwischenfunkt.

Mal sehen was mit 1,4-1,45V so geht...

Robmain schrieb:Fluidmark macht bei mir ca. 8-8ooo Punkte mit SLI (bei 3DMark sind es 17K) . Jedoch bleicbt der Bilschirm schwarz während dessen schwarz. Ist das normal (mit dem schwarbleiben meine ich)?

Nö, ist eigentlich nicht normal.

Normalerweise sollte da ne Kugel zu sehen sein die von ner Fontaine her mit Zeugs berieselt wird. Eben genau so wie auf der HP von den Herstellern zu sehen ist.

8000 Punkte im SLI find ich zudem ned wirklich berauschend. Hatte selbst mit nur einer auf 700MHz GPU auch knapp über 8000

MfG Kennedy

So ich hab meine "8800GT" auch mal kurz getestet.. bei 1150MHz Speichertakt fingen die Fehler an bzw. sah mal Artifakte in LFS (Autosim). Bis 750MHz Coretakt kann ich im Rivatuner wählen, das macht er auch, aber nur wenn der RAM-Takt unter 1000 MHz ist. Mit 750/950 ist er aber langsamer wie 720/1050 deshalb hab ich's so gemacht. Hab nur einmal den 3DMark2001 durchlaufen lassen den ich noch drauf hatte. Scheint also halbwegs stabil zu sein.

Mhh... Das is ja mal interessant!

Das die Chip's fürn Gaming-Bereich auch für CAD eingesetzt wurden is mir bekannt. Die Sache mit der geringeren Taktung ist auch noch verständlich.

Mich wundert allerdings, dass GPU-Z nix vonwegen PCI-E 2.0 anzeigt. Sollte dies bei der Quadro-Version etwa deaktiviert worden sein?!?

Ansonsten ist ein gutes Ergebnis und entspricht dem Durchschnitt würd ich mal sagen. Spitze ist, dass der Speicher trotzdem so hoch geht. Wenn der nur für 800MHz gedacht ist, können die da leicht mise Chips verbaun

Würd auch mal überprüfen was für ne GPU-Spannung im Bios eingetragen ist. Evtl ist da weniger als die normalen 1.05V eingetragen. Dann könnt da noch mehr gehen mit der Karte ohne große Eingriffe

Würd ausserdem noch mit nem andren Tool testen. FurMark, ATI-Tool oder dergleichen. 3DMark2001 dürft wenig aussagekräftig sein

MfG Kennedy

Das die Chip's fürn Gaming-Bereich auch für CAD eingesetzt wurden is mir bekannt. Die Sache mit der geringeren Taktung ist auch noch verständlich.

Mich wundert allerdings, dass GPU-Z nix vonwegen PCI-E 2.0 anzeigt. Sollte dies bei der Quadro-Version etwa deaktiviert worden sein?!?

Ansonsten ist ein gutes Ergebnis und entspricht dem Durchschnitt würd ich mal sagen. Spitze ist, dass der Speicher trotzdem so hoch geht. Wenn der nur für 800MHz gedacht ist, können die da leicht mise Chips verbaun

Würd auch mal überprüfen was für ne GPU-Spannung im Bios eingetragen ist. Evtl ist da weniger als die normalen 1.05V eingetragen. Dann könnt da noch mehr gehen mit der Karte ohne große Eingriffe

Würd ausserdem noch mit nem andren Tool testen. FurMark, ATI-Tool oder dergleichen. 3DMark2001 dürft wenig aussagekräftig sein

MfG Kennedy

Das PCI-E 2.0 fehlt auf anderen Screens teilweise auch hab ich gesehn, hier z.B.

http://www.abload.de/img/13614v9h.jpg

Liegt vielleicht am Vendor der Karte.

Zur Spannung:

https://www.computerbase.de/2008-01/nvidia-praesentiert-quadro-fx-3700-mit-g92/

Zitat:

Der Quadro FX 3700 basiert auf dem Grafikchip G92 und ähnelt in großen Teilen einer GeForce 8800 GT. Mit einem Stromverbrauch von unter 80 Watt ist er jedoch deutlich genügsamer als das Desktop-Derivat mit etwa 110 Watt. Verantwortlich für die geringere Leistungsaufnahme könnten sowohl eine Reduzierung der Taktraten als auch der Betriebsspannung der GPU sein.

Kann also gut sein dass da weniger Spannung anliegt. NVidia soll ja die besonders guten Chips in die teuren Quadro-Karten stecken, vielleicht geht deshalb trotz weniger Spannung der Chiptakt so halbwegs ordentlich hoch.

Werd mir daheim mal den Nibitor laden und schauen was er sagt..

http://www.abload.de/img/13614v9h.jpg

Liegt vielleicht am Vendor der Karte.

Zur Spannung:

https://www.computerbase.de/2008-01/nvidia-praesentiert-quadro-fx-3700-mit-g92/

Zitat:

Der Quadro FX 3700 basiert auf dem Grafikchip G92 und ähnelt in großen Teilen einer GeForce 8800 GT. Mit einem Stromverbrauch von unter 80 Watt ist er jedoch deutlich genügsamer als das Desktop-Derivat mit etwa 110 Watt. Verantwortlich für die geringere Leistungsaufnahme könnten sowohl eine Reduzierung der Taktraten als auch der Betriebsspannung der GPU sein.

Kann also gut sein dass da weniger Spannung anliegt. NVidia soll ja die besonders guten Chips in die teuren Quadro-Karten stecken, vielleicht geht deshalb trotz weniger Spannung der Chiptakt so halbwegs ordentlich hoch.

Werd mir daheim mal den Nibitor laden und schauen was er sagt..

tommy_v6 schrieb:Das PCI-E 2.0 fehlt auf anderen Screens teilweise auch hab ich gesehn, hier z.B.

http://www.abload.de/img/13614v9h.jpg

Schau mal genauer hin

Auf dem verlinkten Screenshot von dir steht "PCI-E 2.0 x16 @ x16" was soviel heißt wie dass die Karte PCI-E 2.0 unterstützt aber damit nicht läuft.

Bei dir hingegen wird bloß "PCI-E x16 @ x16" angezeigt. Denk das dürft am Bios der Karte liegen. Soweit ich weiß gibts von manchen Herstellern Bios'se, die die Unterstützung von PCI-E 2.0 deaktiviern. Brauch man ggf. für ältere Boards die damit Probleme haben.

Spannung ist jedenfalls ne interessante Sache. Die solltest du mal prüfen. Hoffe das Nibitor was mit der Karte anfangen kann, denk aber schon.

Naja ich hab nen Opteron 170 @2800MHz auf nem alten A8N32 SLI Board.. kann sein dass es kein 2.0 unterstützt wobei ich nicht wüsste was das an Leistung bringen soll. X16 hab ich ja.. und die Werte im Vergleich zu ner 8800GT anderer Leute hier mit ähnlichen Systemen sind recht identisch.

Also Nibitor hab ich offen, bei Voltages "Exact Mode" steht Extra 0,95V. 3D und Thrtl ist bei mir leer! Und bei 2D stehen auch 0,95V drin. Bei VID Mode auf dem zweiten Reiter stehen halt vier Spannungen von 1,1V über 1,05V, 1V und 0,95V.

Was heißt das jetzt für mich? Hab von dem Tool keine Ahnung, davon abgesehen dass ich weiß was es - theoretisch - tut.

Kann man denn 1,1 Volt einstellen und flashen? Oder geht da nix ohne Voltmod an der Hardware? Weil ich sag mal von 0,95V auf 1,1 ist schon ne gute Steigerung.. da sollte schon noch was gehen. Mehr wie 85° Volllast hab ich auch noch nie gehabt, ab da dreht der Lüfter denn ordentlich auf.

Andererseits hab ich natürlich Angst als Laie mir meine nicht billige Karte zu zerschießen wenn ich was falsches einstell und nach dem flashen der Bildschirm schwarz bleibt..

Edit: Grad gefunden bezüglich Unterschied PCIE 1.0 vs. 2.0.. bringt in der Praxis wohl fast nix..

Quelle: http://www.tomshardware.com/de/Graf...16-x8-x4-Crossfire,testberichte-239907-5.html

Also Nibitor hab ich offen, bei Voltages "Exact Mode" steht Extra 0,95V. 3D und Thrtl ist bei mir leer! Und bei 2D stehen auch 0,95V drin. Bei VID Mode auf dem zweiten Reiter stehen halt vier Spannungen von 1,1V über 1,05V, 1V und 0,95V.

Was heißt das jetzt für mich? Hab von dem Tool keine Ahnung, davon abgesehen dass ich weiß was es - theoretisch - tut.

Kann man denn 1,1 Volt einstellen und flashen? Oder geht da nix ohne Voltmod an der Hardware? Weil ich sag mal von 0,95V auf 1,1 ist schon ne gute Steigerung.. da sollte schon noch was gehen. Mehr wie 85° Volllast hab ich auch noch nie gehabt, ab da dreht der Lüfter denn ordentlich auf.

Andererseits hab ich natürlich Angst als Laie mir meine nicht billige Karte zu zerschießen wenn ich was falsches einstell und nach dem flashen der Bildschirm schwarz bleibt..

Edit: Grad gefunden bezüglich Unterschied PCIE 1.0 vs. 2.0.. bringt in der Praxis wohl fast nix..

Quelle: http://www.tomshardware.com/de/Graf...16-x8-x4-Crossfire,testberichte-239907-5.html

Zuletzt bearbeitet:

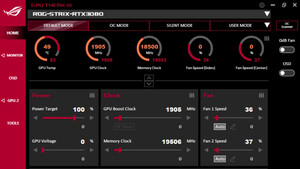

So, Update, habe gerade Bios mit 1,05 Volt Spannung geflasht. Habe jetzt das Problem dass ich im Rivatuner auf maximalem Core-Takt bin und nicht weiß wie ich höher komme, jemand ne Idee?

http://home.tiscali.de/t.antal/oc.jpg

Nach rechts scrollen, da ist der Rivatuner..

http://home.tiscali.de/t.antal/oc.jpg

Nach rechts scrollen, da ist der Rivatuner..

Jo, was den Leistungsunterschied zwischen PCIe 2.0 und 1.1 bzw 1.0 angeht haste natürlich recht. Das macht den Bock ned fett  . Trotzdem wird auf meinem P35-Board das ebenfalls kein 2.0 macht auch die 2.0-Sache in GPU-Z angeigt. Daher meine Vermutung, dass bei den Quadro-Karten dies deaktiviert ist. Wie auch immer, ist ja egal

. Trotzdem wird auf meinem P35-Board das ebenfalls kein 2.0 macht auch die 2.0-Sache in GPU-Z angeigt. Daher meine Vermutung, dass bei den Quadro-Karten dies deaktiviert ist. Wie auch immer, ist ja egal

Zu den Taktraten die du erreichtst: Boah, spitze Da kann man schonmal ned meckern

Da kann man schonmal ned meckern

Da scheint NV wirklich welche von den besseren G92 zu kastrieren und auf die Quadro FX 3700 zu verpflanzen

Zu deinem Problem mit dem Rivatuner: Unter "Power User" --> "Rivatuner \ Overclocking \ Global" gibt die Punkte "MaxClockLimit" und "MinClockLimit". Wenn du da entsprechende Werte einträgst sollte dir ein größerer Bereich zur Verfügung stehen.

Leider funktioniert das gerade bei mir nicht richtig . Wenn ich da Werte eintrag, egal Welche, dann hab ich freie Auswahl zwischen 450MHz und 4GHz

. Wenn ich da Werte eintrag, egal Welche, dann hab ich freie Auswahl zwischen 450MHz und 4GHz

MfG Kennedy

*edit*

Hab nochmal genauer in den Rivatuner reingeschaut In die Felder die ich genannt hab muss man Prozentangaben eintragen (wieder was gelernt *g*). Normalerweise lässt der Treiber bloß bis zu 150% zu. Wenn du dort also 200 einträgst, solltest du volle Auswahl bis zu 1GHz haben

In die Felder die ich genannt hab muss man Prozentangaben eintragen (wieder was gelernt *g*). Normalerweise lässt der Treiber bloß bis zu 150% zu. Wenn du dort also 200 einträgst, solltest du volle Auswahl bis zu 1GHz haben

Zu den Taktraten die du erreichtst: Boah, spitze

Da scheint NV wirklich welche von den besseren G92 zu kastrieren und auf die Quadro FX 3700 zu verpflanzen

Zu deinem Problem mit dem Rivatuner: Unter "Power User" --> "Rivatuner \ Overclocking \ Global" gibt die Punkte "MaxClockLimit" und "MinClockLimit". Wenn du da entsprechende Werte einträgst sollte dir ein größerer Bereich zur Verfügung stehen.

Leider funktioniert das gerade bei mir nicht richtig

MfG Kennedy

*edit*

Hab nochmal genauer in den Rivatuner reingeschaut

Zuletzt bearbeitet:

Ähnliche Themen

- Antworten

- 14

- Aufrufe

- 4.296

- Antworten

- 4

- Aufrufe

- 1.212

- Antworten

- 10

- Aufrufe

- 2.943

- Antworten

- 6

- Aufrufe

- 1.342