Complication

Banned

- Registriert

- Okt. 2009

- Beiträge

- 4.277

Vielleicht nochmal anders herum aufgezäunt:

Eine heutige CPU ohne mathematischen Co-Prozessor würde gar nicht mehr mithalten können. Diese waren früher auch separate Chips und sind aus der CPU heute nicht mehr wegzudenken, da Programmierer sich darauf verlassen können dass ihre Software ihn immer nutzen kann - er sitzt schließlich auf der x86 CPU.

Und jetzt sieh mal den GPU Part einer APU nicht als Grafik sondern als Cuda/Stream Co-Prozessor, der auch die Grafikausgabe bewerkstelligen kann. Bisher konnte sich kein Entwickler sicher sein dass diese zusätzliche DX11 Einheit vorhanden ist wenn er eine Software programmiert hat. Daher wurden nur spezielle Anwendungen mit der Fähigkeit programmiert diese hoch Parallelisierten Funktionen zu nutzen. Das wird sich ändern in dem Moment wo Entwickler sich sicher sein können das solche Stream/CUDA Prozessoren vorhanden sind.

Und wenn deine APU schneller rechnet kann deine HD5870 mehr richtige Grafikarbeit in FPS leisten, als wenn deine CPU keine Stream/CUDA Prozessoren hat und z.B. Physik mit berechnen muss. Warum sind denn so viele scharf darauf Nvidia mit Ati Karten zu kombinieren und jeder Karten unterschiedliche Aufgaben zuzuweisen?

Der Vorteil der APU wird sein, dass man sich keinen Kopf machen muss welche Grafikkarte man einbaut um eine Software in vollem Umfang zu nutzen. Hier wird alles hoch integriert und mit wesentlich weniger Latenz abgearbeitet.

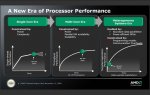

Diese AMD Folie zeigt das vielleicht am besten wo die reise hingehen soll. Schließlich kann man auch die Taktfrequenz nicht unendlich steigern:

Eine heutige CPU ohne mathematischen Co-Prozessor würde gar nicht mehr mithalten können. Diese waren früher auch separate Chips und sind aus der CPU heute nicht mehr wegzudenken, da Programmierer sich darauf verlassen können dass ihre Software ihn immer nutzen kann - er sitzt schließlich auf der x86 CPU.

Und jetzt sieh mal den GPU Part einer APU nicht als Grafik sondern als Cuda/Stream Co-Prozessor, der auch die Grafikausgabe bewerkstelligen kann. Bisher konnte sich kein Entwickler sicher sein dass diese zusätzliche DX11 Einheit vorhanden ist wenn er eine Software programmiert hat. Daher wurden nur spezielle Anwendungen mit der Fähigkeit programmiert diese hoch Parallelisierten Funktionen zu nutzen. Das wird sich ändern in dem Moment wo Entwickler sich sicher sein können das solche Stream/CUDA Prozessoren vorhanden sind.

Und wenn deine APU schneller rechnet kann deine HD5870 mehr richtige Grafikarbeit in FPS leisten, als wenn deine CPU keine Stream/CUDA Prozessoren hat und z.B. Physik mit berechnen muss. Warum sind denn so viele scharf darauf Nvidia mit Ati Karten zu kombinieren und jeder Karten unterschiedliche Aufgaben zuzuweisen?

Der Vorteil der APU wird sein, dass man sich keinen Kopf machen muss welche Grafikkarte man einbaut um eine Software in vollem Umfang zu nutzen. Hier wird alles hoch integriert und mit wesentlich weniger Latenz abgearbeitet.

Diese AMD Folie zeigt das vielleicht am besten wo die reise hingehen soll. Schließlich kann man auch die Taktfrequenz nicht unendlich steigern: