Rock Lee schrieb:

Grundsätzlich haben SSDs HDDs pro" also schon überholt. Nur der Preis/TB ist eben noch ein Faktor

Nicht erst mit der SSD, die

Samsung PM1633a mit 15,36TB ist seit fast 2 Jahren verfügbar und HDDs haben diese Kapazität noch immer noch erreicht.

r4yn3 schrieb:

Autsch Samsung, den Zug hat man wohl verschlafen.

Wieso?

Die Samsung PM1643 30TB ist schon in der Massenproduktion und eine 128GB für dieses Jahr vorgesehen, steht doch im Text:

Samsung will noch dieses Jahr die erste SSD mit 128 TB präsentieren

Verschlafen haben von den große SSD Herstellern wohl eher andere den Trend zu SSDs mit so hohen Kapazitäten. Andererseits ist die Frage wie groß der Markt überhaupt ist.

leipziger1979 schrieb:

Im Server/Storagebereich komplett sinnlos.

Was will ich da mit einer SSD ?

Es wird wohl keiner nur eine kaufen, sondern die werden in großen Mengen gekauft.

leipziger1979 schrieb:

Dann lieber 100x 1TB wo ich dann die maximal theoretischen 100fachen IOPS, und Ausfallredundanz in RAID Verbünden, habe.

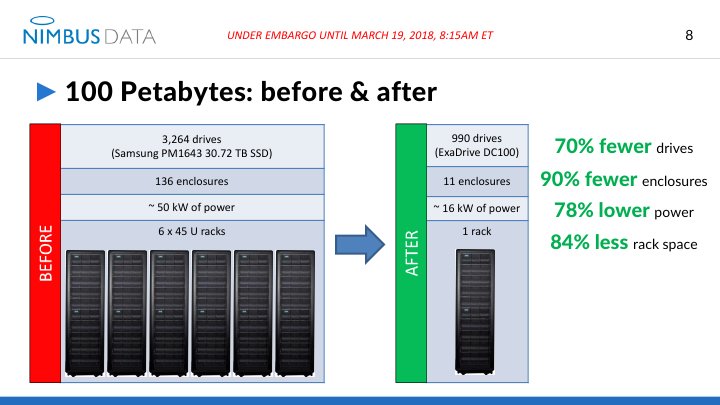

Das Bild sagt doch eigentlich alles:

Die Dinger werden dort interessant wo es im viele PB Storage geht und die Leistung trotzdem noch reicht.

Wobei ich mich frage welche enclosures sind in die 90 3.5" Laufwerke passen? Die alten Pods von Backblaze hatten Platz für 45 in die

neusten Pod 6.0 packen sie sogar 60 (4U), aber 90? Sonst passen ja nicht 990 in 11 enclosures. Andererseits werden 3264 Samsung 30TB PM1643 SSDs zum Vergleich genommen und dann aber nur 24 pro enclosure angenommen, weshalb man dann 136 enclosures braucht, dabei sind die PM1643 2.5" SSDs und nicht 3.5" wie die ExaDrive.

Das passt also nicht zusammen, da gehen ich eher nach der Rechnung die Anandtech für die PM1633a 15,36TB im Vergleich zu 10TB 3.5" HDDs angestellt hat:

Da die PM1643 mit 30,72TB die doppelte Kapazität hat, wären es dann also 1474,76TB pro 2U machine und 30,96TB pro 42U rack für die 2.5"Samsung SSDs und mit 100 statt 10TB pro 3.5" Gehäuse dann 36PB für ein rack, wenn man normale Server Racks nimmt bei denen die Platten von vorne zugänglich sind und damit problemlos im Betrieb getauscht werden können.

Damit hat man keine 20% mehr Kapazität mit dem 100GB 3.5" SSDs pro rack im Vergleich zur Lösung mit 30,72TB 2.5" SSDs, wenn man die unter fairen Voraussetzungen vergleicht. Oder man müsste eben sehen wie viele 2.5" Laufwerke in ein Rack passen dessen enclosures so konstruiert ist wie solche in die 90 3.5" Laufwerke passen sollen.

Bigfoot29 schrieb:

Ich sehe das Einsatz-Szenario durchaus... langfristig.

Im Vergleich zu HDDs spart man ja immer noch einige an Servern und Racks, damit auch Strom (für die HW wie für die Kühöung), Platz und Infrastruktur im Serverraum.

WorldRacer schrieb:

Sagt mal bin ich bescheuert oder warum finde ich das Ding komplett sinnfrei? Wenn es gerade mal mit max. 500 MB/s schreiben und lesen kann, braucht man doch schon über 2 Tage um die SSD komplett zu beschreiben. Wo macht denn bitte sowas Sinn?

Für solche Anwendungen wie Backups. Schau Dir an wie die HW in den Pods bei Backblaze für die Anbindung der HDDs aussieht:

Die meisten Platten hängen an

Marvell 88SE9235 Controllern die 4 Ports haben und ja über zwei PCIe 2.0 Lanes angebunden sind, also real keine 800MB/s für alle 4 Ports bieten und dann wird jeder der 4 Ports

Marvell 88SM9715 SATA Port Multiplier mit einem Host und 5 Device Ports zu den 60 Ports für die HDDs. Für alle 60 HDDs sind also nur so 2400MB/s (pro Richtung, wobei PCIe ja vollduplex ist) an Bandbreite vorhanden, was immer noch reicht um

die beiden 10GbE Ports des Intel X540 auf dem Motherboard voll auszulasten. Damit sind 500MB/s pro Laufwerk also mehr als genug, da die SATA Anbindung bei gleichzeitigen Transfers je Laufwerke nur eine Bandbreite von etwa 40MB/s erlaubt.

Dragon45 schrieb:

Für Datenkraken wie Google oder Facebook. Die sind was Speichermöglichkeiten angeht unermüdlich und über den möglichen Anschaffungspreis da lachen die drüber.

Eben, zumal sie ja auch beim Ausbau der Rechenzentren sparen.

bellencb schrieb:

Etwas mehr Übersetzungsarbeit wäre sinnvoll, alternativ kann man die "nearline"-Kategorie auch erklären.

Enterprise Nearline HDDs sind eine Kategorie von HDDs, die besten von den 3.5" HDDs die mit ihren 550TB/Jahr auch für Dauerlast geeignet sind, wie wie hier es im Modellprogramm von Toshiba aus 2014 zu sehen ist:

drago-museweni schrieb:

vor 4-6Jahren gingen die Preise richtig schön runter...

Nein, vor nicht einmal 2 Jahren waren die ganz unten, danach sind sie gestiegen und nun fallen sie wieder, schau Dir z.B. die

die Preisentwicklung der SanDisk Ultra II 960GB an.

Sinnfrei schrieb:

Micron 5100 und 5200 ECO mit SATA gibt es mit 7680 GB für knapp unter 32 Cent pro GB, das wären ca. 300,- Euro pro TB. Das wäre in etwa der Preis den ich bei der 100 TB SSD erwarten würde, also ca. 30.000 Euro.

Die ganz großen Kapazitäten kosten immer pro GB mehr als die nicht ganz so großen und dann dürfte in dem 100GB Teil einmal ein RAID Controller und eben 4 spezielle SATA SSDs Controller für die je 25TB großen Eingellaufwerke stecken, denn normale Controller unterstützen solche Kapazitäten gar nicht. Es steht ja auch im Text:"Vier Controller und ein Management-Prozessor"

Außerdem steht da auch was von MLC NANDs, die Micron 5100 und 5200 haben hingegen TLC NANDs verbaut, schon von daher wird die 100TB pro GB mindestens um ein Drittel teurer ausfallen.

Sinnfrei schrieb:

würde mir auf jeden Fall Consumer-SSDs mit deutlich mehr Kapazität wünschen, und vielleicht auch mal endlich einem ordentlichen Preisrutsch

Ohne einen Preisrutsch wird es aber keine größeren Kapazitäten geben, denn die 4TB kosten immer noch deutlich über 1200€ und kaum ein Heimanwender ist bereit so viel Geld für eine einzige PC Komponente auszugeben, wie viele würden also über 2400€ für eine 8TB SSD ausgeben? Zumal eine 8TB HDDs nicht einmal ein Zehntel davon kostet.

Wattwanderer schrieb:

Schön, dass HDD nun in Sachen Speicher pro Volumen endgültig abgehängt ist ohne jede Aussicht die Krone wieder zurückzuholen.

Das war schon so und es war klar, dass die HDDs diese Rückstand nicht aufholen würden.

Wattwanderer schrieb:

Dank Streaming ist mein Plattenplatzbedarf über viele Jahre kaum gewachsen.

Und wo lagern die Daten dann? Eben auf solchen gewaltigen Storages bei den Anbietern der Streamingdienste. Die Cloud ist ja so ein niedlich verharmlosender bis verdummender Begriff, die Cloud speichert ja nicht in Wolken, sondern eben in den Rechenzentren der Anbieter.

Rickmer schrieb:

Ich kann mir nicht ganz vorstellen, wo man eine 100TB SSD haben will und mit 500MB/s auskommt... ein bisschen mehr darf schon sein, oder?

Wie das Beispiel oben zeigt, ist die Leistung nicht immer nötig. Es hängt eben immer sehr von der Anwendung ab.

Glyphus schrieb:

Wie sieht das eigentlich mit der Fehlerrate aus? Bei einer UBER von 10^-14 heißt das doch bei 100TB (8*10^14 Bit), das bei einmaligem Vollschreiben im Schnitt 8 unkorrigierbare Fehler entstehen.

Nicht beim Vollschreiben, sondern beim Lesen der ganzen Kapazität, beim Schreiben fallen die Fehler noch gar nicht auf. Außerdem ist bei besseren HDDs eine UBER von 1:10^15 üblich, HDDs die nur eine UBER von 1:10^14 bieten, würde ich mir nicht mehr kaufen und für Enterprise SSDs wie diese sind von der JEDEC 1:10^16 gefordert:

Außerde verhält sich die UBER bei SSDs anderes als bei HDDs, bei denen ist diese während der Nutzungsdauer relativ konstant, während Bitfehler bei SSDs erst gegen Ende der Lebensdauer auftreten, dann aber zunehmen: